Première mondiale : le pipeline de contenu SEO/GEO 100 % automatisé sans API par HDVMA

En 2026, la quasi-totalité des plateformes SaaS de génération de contenu IA partagent un secret bien gardé : elles n’utilisent pas le meilleur modèle de langage disponible. Pour protéger leurs marges, elles font tourner des versions allégées, bridées ou obsolètes — et facturent quand même au token. HDVMA a pris le chemin inverse en construisant le premier pipeline de contenu SEO/GEO 100 % automatisé qui fonctionne sans appel API, toujours avec le modèle le plus puissant du marché. Aujourd’hui Claude Opus 4.6, demain Claude Mythos dès sa sortie. Le résultat : du contenu de niveau expert — 2 000 à 3 000 mots, données structurées, posts réseaux sociaux — à un coût fixe imbattable, là où les concurrents facturent au token avec des modèles inférieurs.

Le problème du marché : des SaaS qui utilisent des modèles IA dégradés

Le marché de la génération de contenu par IA repose sur un paradoxe que la plupart des clients ignorent. Les plateformes SaaS se vendent sur la promesse d’un contenu « propulsé par l’IA », mais la réalité économique les pousse systématiquement à réduire la qualité du modèle sous-jacent pour préserver leurs marges.

Le mécanisme est simple à comprendre. Chaque appel API vers un grand modèle de langage coûte de l’argent au fournisseur SaaS — proportionnellement à la puissance du modèle utilisé. Claude Opus 4.6 coûte 5 $ par million de tokens en entrée et 25 $ en sortie. Un article de 3 000 mots avec son prompt système complet consomme facilement 15 000 à 20 000 tokens en sortie, soit environ 0,40 à 0,50 $ par article uniquement en coût d’inférence. À l’échelle de milliers de clients qui génèrent chacun des dizaines d’articles par mois, la facture API explose. Pour comparaison, les modèles légers comme GPT-3.5 Turbo coûtent jusqu’à 60 fois moins cher que les modèles phares.

La conséquence est prévisible : la majorité des SaaS de contenu IA utilisent des modèles dégradés en coulisses. Des études de développeurs montrent que 70 % des appels API sont routés vers des modèles bon marché même quand le client pense utiliser un modèle premium. Les plateformes mettent en place des « routeurs de modèles » qui envoient automatiquement les requêtes vers le modèle le moins coûteux capable de fournir une réponse acceptable — pas la meilleure réponse possible. Cette pratique, documentée comme stratégie standard d’optimisation des coûts dans l’industrie, signifie que vous payez le prix d’un contenu haut de gamme mais recevez un contenu généré par un modèle inférieur.

| Critère | SaaS contenu IA classique | Pipeline HDVMA |

|---|---|---|

| Modèle utilisé | Modèles légers ou anciens (GPT-3.5, Haiku, Flash) | Toujours le plus puissant (Claude Opus 4.6) |

| Coût pour le client | Variable, au token ou au crédit | Fixe, forfaitaire |

| Qualité du contenu | Générique, souvent superficiel | Expert, données chiffrées, structuré |

| Évolution du modèle | Migration lente (coûts API à recalculer) | Automatique dès sortie du nouveau modèle |

| Transparence | Modèle rarement communiqué | Modèle identifié et garanti |

Le problème ne se limite pas à la qualité brute du texte. Les modèles allégés produisent un contenu qui manque de profondeur analytique, de données chiffrées précises, de structure SEO avancée et de pertinence GEO — exactement les critères qui déterminent si un contenu sera cité par les moteurs de réponse IA en 2026. Pour comprendre comment les IA sélectionnent leurs sources, notre guide complet du GEO détaille les mécanismes de citation.

Les coûts cachés des solutions basées sur les API

Au-delà du choix du modèle, l’architecture API elle-même introduit des coûts structurels que les plateformes SaaS répercutent sur leurs clients — souvent de manière opaque. Comprendre ces mécanismes permet de mesurer l’avantage concurrentiel d’un pipeline sans API.

Le premier poste de coût caché est le pricing au token. Un token représente environ quatre caractères en anglais, mais les langues latines comme le français sont « tokenisées » de manière moins efficace — un même texte français consomme en moyenne 20 à 30 % de tokens de plus que son équivalent anglais. Les SaaS qui facturent au token ou au crédit ne communiquent pas cette surcharge linguistique. Un article de 3 000 mots en français peut coûter jusqu’à 30 % de plus qu’un article équivalent en anglais, sans que le client en soit informé.

Le deuxième facteur est le coût du contexte. Les modèles de langage fonctionnent avec une « fenêtre de contexte » — la quantité de texte qu’ils peuvent traiter en une seule requête. Pour produire un contenu véritablement expert, le modèle a besoin d’un contexte riche : instructions de rédaction détaillées, données de recherche, exemples de structure, consignes SEO, briefing du client. Ce contexte consomme des tokens d’entrée facturés au même titre que le contenu généré. Les SaaS qui optimisent leurs coûts réduisent ce contexte au minimum, ce qui explique pourquoi le contenu produit est souvent générique et peu différencié.

Le troisième coût caché concerne les rate limits et la fiabilité. Les fournisseurs d’API imposent des limites d’utilisation par palier. Un SaaS qui sert des milliers de clients simultanés doit négocier des tiers d’accès élevés ou gérer des files d’attente, ce qui ajoute de la latence et de la complexité opérationnelle. En période de forte demande, certaines requêtes échouent ou sont rétrogradées vers des modèles inférieurs — sans notification au client.

| Poste de coût | Impact sur le SaaS | Répercussion client |

|---|---|---|

| Tokens d’entrée (contexte + prompt) | 2 à 5 $ / million tokens | Contexte réduit = contenu générique |

| Tokens de sortie (contenu généré) | 10 à 25 $ / million tokens | Articles courts ou modèle dégradé |

| Surcoût linguistique (français) | +20 à 30 % vs anglais | Facturé mais jamais communiqué |

| Rate limits et échecs API | Latence, retries, downgrades | Délais et qualité variable |

| Infrastructure de routage | Cache, load balancing, monitoring | Coût intégré au prix final |

Ces coûts cumulés expliquent pourquoi les tarifs des SaaS de contenu IA restent élevés malgré la baisse continue des prix unitaires par token. La facturation des API LLM a baissé d’un facteur 1 000 en trois ans, mais les économies n’ont pas été répercutées sur les clients parce que les SaaS les ont absorbées pour compenser d’autres postes — ou simplement pour maintenir leurs marges. Notre analyse détaillée des coûts des API LLM en 2026 démontre pourquoi ce modèle économique atteint ses limites.

L’approche HDVMA : toujours le dernier modèle, zéro coût variable

Face aux limites structurelles du modèle API, HDVMA a conçu une architecture fondamentalement différente. Le pipeline de contenu HDVMA fonctionne sans aucun appel API vers un fournisseur de modèle de langage — et c’est cette absence qui constitue son avantage concurrentiel décisif.

Le principe est radical dans sa simplicité : au lieu de payer chaque requête au token via une API, le pipeline utilise directement le modèle le plus puissant disponible dans un environnement local. Aujourd’hui, c’est Claude Opus 4.6 d’Anthropic — le modèle qui a permis à 16 agents IA d’écrire un compilateur C en Rust capable de compiler le noyau Linux. Le même modèle que les entreprises paient 25 $ par million de tokens en sortie via l’API est utilisé par HDVMA à coût fixe, sans plafond d’utilisation, sans limitation de contexte et sans dégradation de qualité.

Cette architecture élimine d’un coup tous les coûts cachés identifiés précédemment. Le contexte transmis au modèle n’est plus contraint par un budget de tokens : le pipeline envoie un briefing complet comprenant les consignes rédactionnelles détaillées, les données de recherche actualisées, la structure SEO/GEO optimale, les données structurées Schema.org, et le maillage interne du site client. Là où un SaaS classique réduit ce contexte à quelques lignes pour économiser des tokens, HDVMA exploite la totalité de la fenêtre de contexte d’un million de tokens disponible sur Claude Opus 4.6.

Le résultat en termes de qualité est mesurable. Un article produit par le pipeline HDVMA intègre systématiquement des données chiffrées issues de sources d’autorité, des tableaux comparatifs structurés, 10 FAQ avec schéma JSON-LD synchronisé, des balises Schema.org HowTo, un maillage interne vérifié lien par lien, et trois posts réseaux sociaux calibrés par plateforme. Ce niveau de complétude nécessite un modèle capable de raisonnement complexe et de suivi d’instructions longues — exactement ce que les modèles légers utilisés par les SaaS ne peuvent pas offrir.

L’impact économique est considérable. Un SaaS de contenu IA qui facture entre 49 et 299 $ par mois pour un volume limité d’articles utilise en coulisses un modèle qui coûte une fraction du modèle phare. HDVMA propose un pipeline capable de produire 50 articles par mois pour 399 € — avec le meilleur modèle du marché, pas une version allégée. Le rapport qualité-prix est sans équivalent dans l’industrie.

Évolutivité native : de Claude Opus 4.6 à Claude Mythos

L’un des avantages les plus sous-estimés d’un pipeline sans API est sa capacité d’évolution automatique. Quand Anthropic publie un nouveau modèle, le pipeline HDVMA en bénéficie immédiatement — sans migration, sans recalcul de coûts, sans période de transition.

Cette évolutivité native prend une dimension concrète avec l’arrivée imminente de Claude Mythos, le prochain modèle phare d’Anthropic. Révélé accidentellement fin mars 2026 suite à une erreur de configuration dans le système de gestion de contenu d’Anthropic, Mythos représente un saut qualitatif majeur. Anthropic a confirmé développer un modèle avec des « avancées significatives en raisonnement, programmation et cybersécurité », qu’ils considèrent comme « le plus capable jamais construit ». Les documents internes décrivent Mythos comme « plus grand et plus intelligent que les modèles Opus — qui étaient, jusqu’à présent, les plus puissants ».

Pour un SaaS basé sur les API, l’arrivée d’un modèle supérieur pose un dilemme économique. Mythos sera vraisemblablement plus cher que Opus 4.6 à l’utilisation API — Anthropic prévoit un nouveau palier tarifaire au-dessus d’Opus. Le SaaS doit alors choisir : absorber le surcoût (et réduire ses marges), augmenter ses prix (et risquer de perdre des clients), ou rester sur l’ancien modèle (et se faire dépasser en qualité). La plupart choisissent la troisième option, ce qui explique pourquoi certaines plateformes utilisent encore des modèles de deux générations précédentes.

Pour le pipeline HDVMA, ce dilemme n’existe pas. Dès que Claude Mythos sera accessible, le pipeline basculera naturellement vers ce modèle — avec ses capacités de raisonnement supérieures, sa précision accrue et sa fenêtre de contexte potentiellement encore plus large. Les clients HDVMA bénéficieront automatiquement de cette amélioration, sans surcoût et sans interruption de service. Cette logique s’applique à chaque génération de modèle : le pipeline a traversé les évolutions de Claude 3.5 à Opus 4.6 sans modification structurelle.

| Modèle | Coût API sortie (par million tokens) | Impact SaaS classique | Impact pipeline HDVMA |

|---|---|---|---|

| Claude Haiku 4.5 | 1,25 $ | Utilisé par défaut par la plupart des SaaS | Non utilisé (modèle inférieur) |

| Claude Sonnet 4.6 | 15 $ | Utilisé occasionnellement pour les tâches complexes | Non utilisé (modèle intermédiaire) |

| Claude Opus 4.6 | 25 $ | Trop cher pour un usage systématique | Utilisé pour 100 % des articles |

| Claude Mythos (à venir) | Estimation : 35-50 $ | Inaccessible pour la plupart des SaaS | Intégré automatiquement dès sa sortie |

L’historique des coûts d’inférence confirme cette dynamique. Les prix unitaires par token ont été divisés par 1 000 en trois ans, passant d’environ 12 $ par million de tokens de sortie avec GPT-3.5 en 2022 à moins de 2 $ avec les modèles Flash en 2024. Mais les modèles phares restent chers parce qu’ils offrent des capacités sans commune mesure. L’architecture HDVMA est la seule qui permette d’utiliser systématiquement le modèle le plus cher — et donc le plus performant — sans que le coût ne devienne prohibitif. Pour comprendre en détail cette dynamique de marché, consultez notre analyse de la rédaction automatisée de contenu SEO et GEO en 2026.

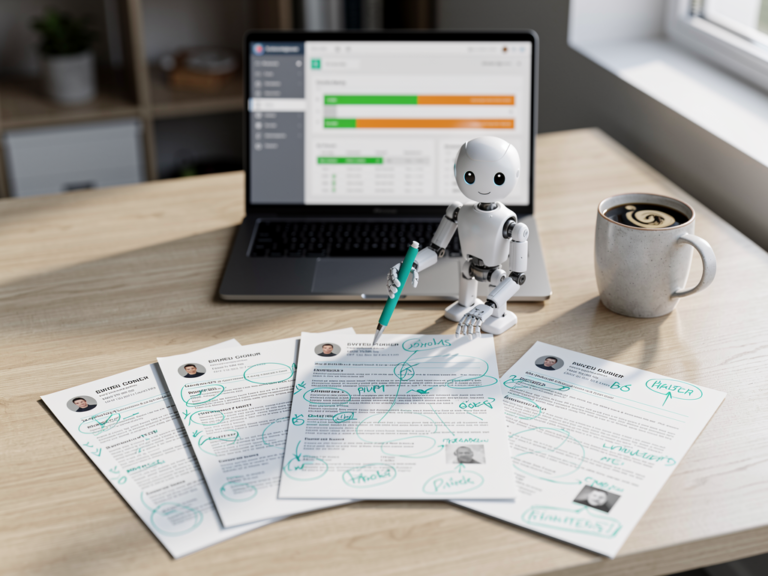

Le portail client : scoring SEO/GEO/SXO et angle de rédaction

Un pipeline de contenu performant ne se résume pas au modèle de langage. La valeur ajoutée réside dans l’orchestration intelligente de la production — et c’est là que le portail client HDVMA transforme une capacité technique en avantage commercial.

Le portail client HDVMA permet à chaque entreprise de soumettre ses sujets d’articles avec un système de scoring triple : SEO (optimisation pour les moteurs de recherche classiques), GEO (optimisation pour les moteurs de réponse IA) et SXO (Search Experience Optimization, qui intègre l’expérience utilisateur dans l’équation). Chaque sujet reçoit une note sur 10 pour chaque dimension, ce qui permet de prioriser la production en fonction de l’impact attendu. Un sujet noté SEO 9 / GEO 10 / SXO 8 sera traité en priorité parce qu’il combine un fort potentiel de classement Google, une forte probabilité de citation par les IA et une expérience utilisateur optimale.

Au-delà du scoring, le portail intègre le choix de l’angle de rédaction. Un même sujet peut être traité sous l’angle « analyse expert », « guide pratique », « étude de cas », « comparatif » ou « tribune sectorielle ». Ce choix influence directement la structure de l’article, le ton rédactionnel, le type de données intégrées et la stratégie de maillage interne. Un angle « analyse expert » privilégiera les données chiffrées et les comparaisons sectorielles. Un angle « guide pratique » structurera le contenu en étapes actionnables avec un schéma HowTo en JSON-LD.

Cette approche résout un problème fondamental des SaaS de contenu : la personnalisation à l’échelle. Les plateformes généralistes produisent un contenu standardisé qui ressemble à tous les autres contenus générés par IA. Le pipeline HDVMA, alimenté par le portail client, produit un contenu calibré pour le secteur d’activité, le positionnement de marque et les objectifs de visibilité spécifiques de chaque client. Un article pour un cabinet d’avocats n’aura ni le même vocabulaire, ni la même structure, ni les mêmes références qu’un article pour un acteur du nautisme — et les deux seront optimisés pour être cités par les IA. Nos pages sectorielles illustrent cette diversité, que ce soit pour les avocats, le nautisme, la restauration ou les PME.

| Fonctionnalité portail | Ce que ça change | Impact sur le contenu |

|---|---|---|

| Scoring SEO (sur 10) | Priorisation par potentiel de classement | Mots-clés, structure, maillage optimisés |

| Scoring GEO (sur 10) | Priorisation par potentiel de citation IA | Données structurées, FAQ, autorité d’entité |

| Scoring SXO (sur 10) | Priorisation par expérience utilisateur | Lisibilité, navigation, engagement |

| Angle de rédaction | Personnalisation du traitement éditorial | Ton, structure, type de données intégrées |

| Secteur d’activité | Contextualisation métier | Vocabulaire, références, maillage sectoriel |

Le portail sert aussi d’interface de suivi. Le client voit en temps réel l’état de production de ses articles, les scores attribués, et peut accéder aux contenus publiés avec leurs métriques de performance initiales. Cette transparence est un autre différenciateur : là où les SaaS masquent le modèle utilisé et les processus internes, HDVMA donne au client une visibilité complète sur la chaîne de production. Pour évaluer votre propre maturité IA avant de vous lancer, notre Diagnostic IA personnel identifie vos meilleurs points d’entrée en 5 minutes.

Résultat business : contenu expert à coût fixe imbattable

La promesse est ambitieuse — et les résultats mesurables. Le pipeline HDVMA produit un contenu qui rivalise avec celui d’un rédacteur expert senior, à un coût fixe qui défie toute concurrence dans le marché du contenu marketing.

Chaque article issu du pipeline présente des caractéristiques qui le distinguent immédiatement d’un contenu IA générique. En termes quantitatifs : 2 000 à 3 000 mots de contenu expert, structuré en 6 sections thématiques avec des sous-parties, enrichi de 2 à 5 tableaux HTML responsives, de 10 FAQ visibles avec leur équivalent JSON-LD FAQPage pour le référencement enrichi, et d’un schéma HowTo quand le sujet s’y prête. Chaque article est accompagné de trois posts réseaux sociaux calibrés — LinkedIn (950 caractères avec chiffres clés), Facebook (480 caractères avec accroche émotionnelle), Instagram (250 caractères avec 15 à 20 hashtags ciblés). Le tout est livré avec son image à la une générée par IA et sa vidéo sociale.

En termes qualitatifs, le différenciateur principal est la profondeur analytique. Le modèle phare dispose de la capacité de raisonnement nécessaire pour croiser des sources, identifier des tendances contre-intuitives, structurer une argumentation nuancée et intégrer des données chiffrées vérifiables. Un modèle allégé se contente de reformuler des informations de surface — il n’a tout simplement pas la puissance cognitive pour produire une analyse de niveau expert. C’est la différence entre un article qui occupe de l’espace et un article qui génère de l’autorité.

Le cas BoatCible illustre concrètement cette puissance. Ce site d’annonces nautiques a atteint +320 % de trafic organique avec zéro euro de budget publicitaire, en s’appuyant sur un contenu SEO/GEO produit par le pipeline HDVMA. Le site est aujourd’hui cité par ChatGPT et Perplexity comme source d’autorité dans son secteur — un résultat qui ne s’obtient pas avec du contenu IA générique. Notre étude de cas BoatCible détaille la méthode complète.

| Composant de l’article | SaaS contenu IA (modèle léger) | Pipeline HDVMA (Opus 4.6) |

|---|---|---|

| Longueur | 500-1 200 mots | 2 000-3 000 mots |

| Données chiffrées | Rarement intégrées | Sources d’autorité dans chaque section |

| Données structurées | Absentes ou basiques | FAQPage + HowTo JSON-LD synchronisés |

| Tableaux comparatifs | Aucun | 2 à 5 tableaux responsives |

| Maillage interne | Générique ou absent | 5-10 liens vérifiés par HTTP |

| Posts réseaux sociaux | Non inclus | 3 posts (LinkedIn, Facebook, Instagram) |

| Image + vidéo | Stock photo générique | Image IA contextuelle + vidéo sociale |

L’équation économique finale est sans appel. Une prestation de rédaction expert par une agence SEO coûte entre 300 et 800 € par article. Un SaaS de contenu IA facture entre 49 et 299 € par mois pour un volume limité d’articles de qualité moyenne. Le pipeline HDVMA produit du contenu de niveau agence, à un coût fixe qui rend la production de 50 articles mensuels économiquement viable pour une PME. Cette accessibilité transforme la stratégie de contenu : au lieu de publier 2 ou 3 articles par mois en espérant un miracle, les entreprises peuvent déployer une véritable stratégie SEO et GEO automatisée avec un volume suffisant pour construire une autorité sectorielle.

Les secteurs d’activité qui adoptent cette approche dès maintenant prennent une avance mesurable. Le GEO récompense le volume et la cohérence : plus votre site produit du contenu expert sur son domaine, plus les IA le citent comme source d’autorité. Le pipeline HDVMA est conçu pour alimenter cette boucle vertueuse de manière continue, avec le meilleur modèle disponible à chaque instant.

Questions fréquentes sur le pipeline de contenu HDVMA

Qu’est-ce qu’un pipeline de contenu sans API ?

Un pipeline de contenu sans API est un système de production de contenu automatisé qui utilise un modèle de langage directement, sans passer par les interfaces de programmation facturées au token des fournisseurs. Contrairement aux SaaS classiques qui paient chaque requête au modèle, le pipeline HDVMA accède au modèle le plus puissant à coût fixe, éliminant les coûts variables et permettant d’utiliser 100 % des capacités du modèle sans restriction.

Pourquoi les SaaS de contenu IA utilisent-ils des modèles dégradés ?

Les SaaS de contenu IA utilisent des modèles dégradés pour protéger leurs marges. Chaque appel API vers un modèle puissant comme Claude Opus 4.6 coûte 25 $ par million de tokens en sortie, contre 1,25 $ pour un modèle léger comme Haiku. À l’échelle de milliers de clients, la différence se chiffre en millions de dollars. Les plateformes mettent en place des routeurs qui envoient automatiquement 70 % des requêtes vers les modèles les moins coûteux, même quand le client pense utiliser le modèle premium.

Quel modèle IA utilise le pipeline HDVMA ?

Le pipeline HDVMA utilise systématiquement le modèle le plus puissant disponible. En avril 2026, c’est Claude Opus 4.6 d’Anthropic, le modèle phare qui a notamment permis à 16 agents IA d’écrire un compilateur C complet en Rust. Dès la sortie de Claude Mythos, le prochain modèle d’Anthropic confirmé comme encore plus performant, le pipeline y basculera automatiquement sans surcoût pour les clients.

Qu’est-ce que Claude Mythos et quand sera-t-il disponible ?

Claude Mythos est le prochain modèle phare d’Anthropic, révélé accidentellement fin mars 2026. Anthropic a confirmé développer un modèle avec des avancées significatives en raisonnement, programmation et cybersécurité, qu’ils décrivent comme le plus capable jamais construit. Les estimations de lancement situent sa sortie entre le troisième et le quatrième trimestre 2026. Le pipeline HDVMA en bénéficiera automatiquement dès sa disponibilité.

Combien coûte le pipeline de contenu HDVMA ?

Le pipeline HDVMA fonctionne à coût fixe forfaitaire, contrairement aux SaaS qui facturent au token ou au crédit. L’offre de référence permet de produire 50 articles SEO/GEO optimisés par mois pour 399 €, soit moins de 8 € par article complet de 2 000 à 3 000 mots avec données structurées, posts réseaux sociaux, image IA et vidéo sociale. Pour comparaison, un article de qualité équivalente coûte entre 300 et 800 € en rédaction par une agence.

Quelle est la différence entre un contenu IA générique et un contenu expert ?

Un contenu IA générique est produit par un modèle léger avec un contexte réduit : il reformule des informations de surface sans profondeur analytique. Un contenu expert, comme celui du pipeline HDVMA, intègre des données chiffrées vérifiables, des tableaux comparatifs structurés, des analyses sectorielles nuancées, un balisage Schema.org complet et un maillage interne vérifié. C’est la différence entre un article qui occupe de l’espace et un article qui construit l’autorité de votre marque.

Comment fonctionne le scoring SEO/GEO/SXO du portail client ?

Le portail client HDVMA attribue à chaque sujet d’article trois notes sur 10 : SEO pour le potentiel de classement Google, GEO pour le potentiel de citation par les IA comme ChatGPT et Perplexity, et SXO pour la qualité de l’expérience utilisateur. Ce triple scoring permet de prioriser la production sur les sujets à plus fort impact et d’adapter la structure de chaque article aux dimensions prioritaires identifiées.

Le pipeline HDVMA produit-il aussi les images et les vidéos ?

Oui. Chaque article est accompagné d’une image à la une générée par IA via Flux 2 Pro, calibrée pour illustrer le sujet réel de l’article avec un traitement visuel créatif — pas une photo stock générique. Une vidéo sociale est également produite automatiquement pour alimenter les réseaux sociaux. Trois posts sont générés et calibrés par plateforme : LinkedIn, Facebook et Instagram.

Quels secteurs d’activité peuvent utiliser le pipeline HDVMA ?

Le pipeline est conçu pour s’adapter à tous les secteurs d’activité. Il est actuellement déployé dans le nautisme, le droit, la restauration, le BTP, la comptabilité, l’informatique et les services aux PME. Le portail client permet de configurer le vocabulaire sectoriel, les références métier et le maillage interne spécifique à chaque domaine. Les mécanismes SEO/GEO sont universels : l’IA récompense l’autorité, la clarté et la fraîcheur du contenu dans tous les secteurs.

Comment le pipeline garantit-il la qualité du contenu produit ?

La qualité est garantie par trois mécanismes. Le modèle le plus puissant du marché assure la profondeur analytique et la précision factuelle. Le système de consignes détaillées, transmis intégralement au modèle sans restriction de tokens, standardise la structure et les exigences qualitatives. Chaque lien interne est vérifié par requête HTTP avant publication pour éviter les erreurs 404. Le résultat est un contenu conforme aux standards de rédaction expert avec une cohérence industrielle.

Diag IA gratuit

Nous contacter

Parler à Eric