OCuLink et eGPU sur mini PC : transformer une RTX 3060 en station IA locale pour moins de 700 euros

Un port OCuLink (PCIe 4.0 x4, 64 Gbps) connecté à une RTX 3060 12 Go d’occasion atteint 90 % des performances d’un GPU installé en desktop, pour un budget total inférieur à 700 euros (mini PC + GPU + dock). Le marché de l’edge AI atteint 29,98 milliards de dollars en 2026 (Grand View Research, 2026). Les mini PC AMD Ryzen équipés d’OCuLink transforment la station de travail compacte en plateforme GPU évolutive pour l’inférence IA locale, le fine-tuning de modèles et le traitement vidéo.

Temps de lecture : 15 min

À retenir

- OCuLink (PCIe 4.0 x4, 64 Gbps) offre 177 % de bande passante en plus que Thunderbolt 4 (40 Gbps) pour les GPU externes

- Une RTX 3060 12 Go via OCuLink traite des modèles LLM 14B à 22,6 tokens/seconde et des images Stable Diffusion à 5-7 itérations/seconde

- Le budget total mini PC + RTX 3060 d’occasion + dock OCuLink revient entre 600 et 800 euros, contre 1 500+ euros pour un desktop équivalent

- Les cas d’usage couvrent l’inférence LLM locale, l’anonymisation NER, la génération d’images, le montage vidéo et l’entraînement de modèles légers

Pourquoi l’OCuLink change-t-il la donne pour les GPU externes en 2026 ?

L’OCuLink (Optical-Copper Link) est un connecteur PCIe direct qui relie un GPU externe à un mini PC via 4 lignes PCIe 4.0, offrant 64 Gbps de bande passante brute. Cette connexion fonctionne comme un slot PCIe natif, sans la couche protocolaire qui freine Thunderbolt.

OCuLink vs Thunderbolt 4 vs USB4 : les chiffres réels

| Interface | Bande passante | Perte GPU estimée | Hot-plug |

|---|---|---|---|

| PCIe x16 natif (desktop) | 256 Gbps | 0 % | Non |

| OCuLink (PCIe 4.0 x4) | 64 Gbps | 10-20 % | Non |

| Thunderbolt 5 | 80 Gbps (120 burst) | 15-25 % | Oui |

| Thunderbolt 4 / USB4 | 40 Gbps | 25-40 % | Oui |

Les benchmarks 3DMark PCIe confirment un gain de bande passante de 177 % pour OCuLink par rapport à Thunderbolt 4 sur le MINISFORUM AtomMan X7 Ti (XDA Developers, novembre 2024). En jeu, les gains se traduisent par des framerates plus stables et des frametimes plus réguliers. En inférence IA, la bande passante accrue réduit le temps de chargement des modèles et accélère les transferts de tenseurs entre CPU et GPU.

Pourquoi OCuLink convient particulièrement aux charges IA

Les charges de travail IA présentent une caractéristique favorable aux connexions eGPU : une fois le modèle chargé en VRAM, les échanges CPU-GPU deviennent limités. Un modèle Llama 8B quantifié occupe 5-6 Go de VRAM et traite les tokens en quasi-autonomie sur le GPU. La bande passante OCuLink (64 Gbps) dépasse largement les besoins de transfert en cours d’inférence.

La pénalité de 10-20 % par rapport à un slot natif se concentre sur le chargement initial du modèle, pas sur la génération de tokens. Cette caractéristique fait de l’eGPU OCuLink une solution adaptée aux déploiements locaux de LLM (Qwen, DeepSeek, Llama), où la VRAM dédiée du GPU élimine le goulot d’étranglement de la mémoire partagée CPU.

Quels mini PC intègrent un port OCuLink en 2026 ?

Le port OCuLink est passé d’une curiosité de niche en 2024 à un standard courant sur les mini PC AMD haut de gamme en 2026. Les fabricants (GMKtec, MINISFORUM, AOOSTAR, Beelink) ont généralisé cette connectique sur leurs gammes Ryzen 7 et Ryzen 9.

Les modèles recommandés par prix et usage

| Mini PC | CPU | RAM | Prix indicatif |

|---|---|---|---|

| GMKtec K8 Plus | Ryzen 7 8845HS | 32 Go DDR5-5600 | ~810 euros |

| MINISFORUM UM880 Plus | Ryzen 7 8845HS | 32 Go DDR5 | ~750 euros |

| AOOSTAR GEM 12 | Ryzen 9 6900HX | 16/32 Go DDR5 | ~400 euros |

| GMKtec K12 | Ryzen 7 H255 | 64 Go DDR5 | ~900 euros |

L’AOOSTAR GEM 12 (~400 euros) offre le meilleur rapport qualité-prix grâce à ses 4 lignes PCIe dédiées à l’OCuLink qui ne partagent pas de bande passante avec les SSD NVMe. Le GMKtec K8 Plus combine OCuLink, USB4, double Ethernet 2,5 Gbps et 3 slots SSD.

En pratique

Avant d’acheter un mini PC OCuLink, vérifier que les lignes PCIe du port sont dédiées et ne partagent pas la bande passante avec un slot M.2 NVMe. Le AOOSTAR GEM 10/12 offre cette garantie. Sur certains modèles, brancher un eGPU via OCuLink désactive un des slots SSD internes.

Pourquoi la RTX 3060 12 Go reste-t-elle le meilleur choix eGPU budget ?

La RTX 3060 12 Go est le GPU NVIDIA le moins cher qui offre 12 Go de VRAM GDDR6 avec une bande passante mémoire de 360 Go/s et le support complet de CUDA, TensorRT et cuDNN. Ces trois éléments conditionnent la viabilité de l’inférence IA locale.

12 Go de VRAM : le seuil critique pour l’IA locale

La VRAM détermine la taille maximale du modèle chargeable. Un modèle Llama 3 8B en quantification Q4_K_M occupe 5-6 Go. Un modèle Qwen3 14B en Q4 occupe 9-10 Go. La RTX 3060 12 Go charge ces deux modèles entièrement en VRAM, sans recours au CPU offloading qui divise la vitesse par 5.

Les benchmarks de mars 2026 confirment que la RTX 3060 12 Go traite les modèles 14B à 22,6 tokens/seconde en génération et 678 tokens/seconde en traitement de prompt (Hardware Corner, mars 2026). Ces chiffres surpassent la RTX 4060 en génération de tokens grâce à la bande passante mémoire supérieure (360 Go/s contre 288 Go/s).

Prix d’occasion et rapport performance/euro

La RTX 3060 12 Go se trouve entre 150 et 250 euros d’occasion en Europe (Leboncoin, eBay, marketplaces spécialisées). Le prix neuf reste autour de 279-329 dollars. Le ratio VRAM/euro est imbattable : 12 Go pour ~200 euros, soit 16,7 euros par Go de VRAM.

- RTX 3060 12 Go : ~200 euros occasion, 12 Go VRAM, 360 Go/s, 170 W TDP, modèles jusqu’à 14B (Q4)

- RTX 3060 Ti 8 Go : ~220 euros occasion, 8 Go VRAM, 448 Go/s, 200 W TDP, modèles jusqu’à 8B (Q8)

- RTX 4060 8 Go : ~300 euros neuf, 8 Go VRAM, 272 Go/s, 115 W TDP, modèles jusqu’à 8B (Q8)

- Intel Arc B580 12 Go : ~250 euros neuf, 12 Go VRAM, support oneAPI (pas CUDA)

- RTX 3090 24 Go : ~700 euros occasion, 24 Go VRAM, 936 Go/s, 350 W TDP, modèles jusqu’à 70B (Q4)

La RTX 3060 12 Go consomme 170 watts sous charge, compatible avec les alimentations 550 W standard. Les docks eGPU intègrent souvent une alimentation ATX séparée, isolant la consommation du GPU de celle du mini PC.

Évaluez votre maturité IA en 5 minutes avec notre Diagnostic IA gratuit.

Quels cas d’usage IA profitent le plus d’un eGPU OCuLink ?

L’eGPU OCuLink transforme un mini PC de bureau en station de travail IA polyvalente. Quatre cas d’usage principaux tirent le meilleur parti de cette architecture.

Inférence LLM locale : conversations privées et illimitées

Un mini PC AMD + RTX 3060 12 Go via OCuLink exécute Ollama, llama.cpp ou vLLM avec des modèles 7B-14B à des vitesses conversationnelles (12-22 tokens/seconde). Le coût mensuel se limite à l’électricité (~5 euros). Aucune API, aucun abonnement, aucune fuite de données.

Pour les pipelines d’anonymisation NER locale, la RTX 3060 accélère GLiNER2 de 3 à 5 fois par rapport au CPU Ryzen. Le traitement de 10 000 pages juridiques passe de 17 heures (CPU) à 3-4 heures (GPU).

Génération d’images et montage vidéo GPU-accéléré

Stable Diffusion XL exige 12 Go de VRAM minimum. La RTX 3060 12 Go est le GPU le moins cher qui exécute SDXL sans compromis. La vitesse atteint 5-7 itérations/seconde en résolution 512×512. Le fine-tuning LoRA (DreamBooth, Kohya) fonctionne avec des batch sizes de 1-2.

DaVinci Resolve, Premiere Pro et After Effects exploitent CUDA pour le décodage vidéo, le color grading et les effets IA. Un eGPU OCuLink réduit les temps de rendu de 60-70 % par rapport au CPU seul. La création de contenu vidéo IA profite directement de cette puissance GPU locale.

Gaming et usage polyvalent au quotidien

L’eGPU OCuLink n’est pas réservé à l’IA. Les benchmarks 3DMark Time Spy montrent que la RTX 3060 via OCuLink atteint 90 % des scores d’un desktop natif. Les jeux AAA tournent en 1080p avec des réglages élevés à 60+ FPS. Cyberpunk 2077 avec FSR activé dépasse 85 FPS en 1080p.

Un mini PC avec eGPU remplace donc un desktop gaming complet. La semaine, il sert de station de travail IA (inférence LLM, traitement NER, génération d’images). Le week-end, il devient une machine de jeu performante. Le format compact libère l’espace de bureau tout en offrant la puissance d’un tour ATX. L’ensemble mini PC + dock + GPU occupe moins de 30 cm de largeur sur le bureau, contre 50 cm minimum pour un tour desktop classique avec son alimentation.

La double utilisation justifie l’investissement pour les indépendants et les petites équipes qui ne veulent pas maintenir deux machines séparées. Le mini PC consomme 10-15 watts au repos, le GPU ne tire de l’énergie que quand il est sollicité.

Développement ML et fine-tuning de modèles

Les data scientists qui prototypent des modèles PyTorch ou TensorFlow bénéficient des Tensor Cores de la RTX 3060 (112 unités). Un LoRA sur un modèle 7B prend 2-4 heures sur RTX 3060, contre 20+ heures sur CPU. Le fine-tuning NER pour l’anonymisation juridique est un cas d’usage concret de cette approche.

L’architecture eGPU permet de débrancher le GPU quand il n’est pas utilisé, réduisant la consommation au repos à celle du mini PC seul (10-15 watts). Les workflows automatisés qui alternent tâches bureautiques et charges IA profitent de cette flexibilité.

En pratique

Un développeur IA utilisant un GMKtec K8 Plus avec RTX 3060 via OCuLink rapporte des scores 3DMark Time Spy à 90 % d’un desktop natif. Pour les charges IA, la pénalité OCuLink tombe à 5-10 % car le goulot d’étranglement se situe dans le calcul GPU, pas dans le transfert PCIe.

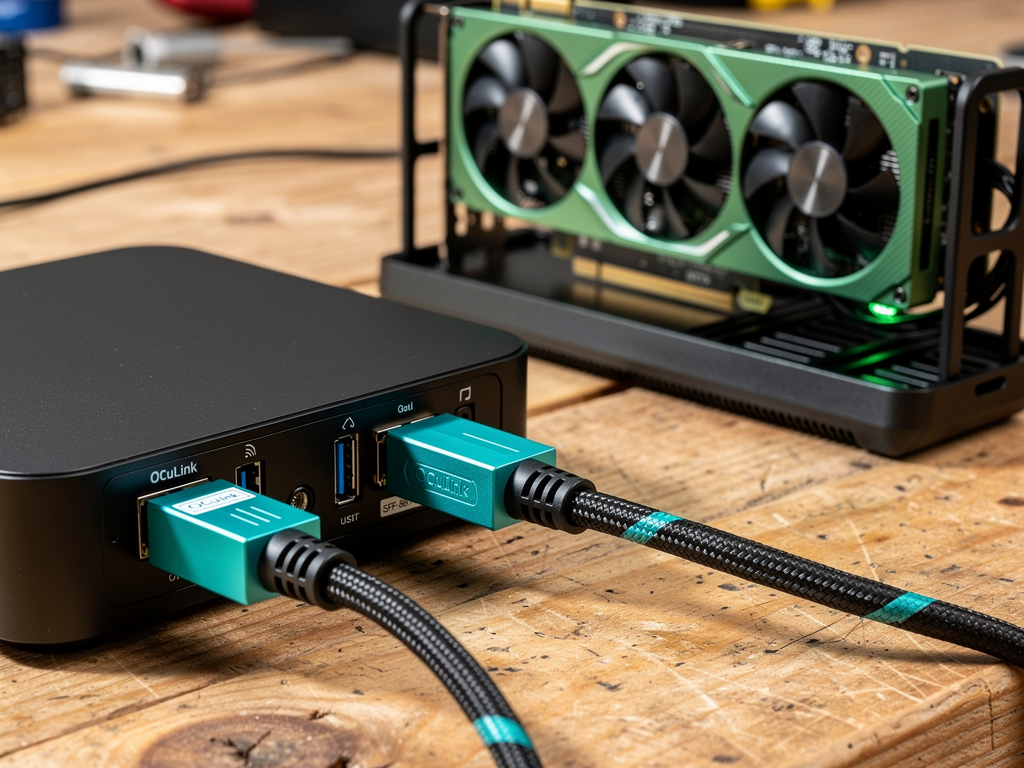

Comment monter et configurer un eGPU OCuLink pas à pas ?

Le montage d’un eGPU OCuLink nécessite trois composants : un mini PC avec port OCuLink, un dock ou adaptateur eGPU, et un GPU desktop avec son alimentation. La procédure prend 15 à 30 minutes.

Choisir le dock et installer le GPU

Les docks compacts (MINISFORUM DEG1/DEG2, GTBox G-Dock) intègrent un slot PCIe x16. Le MINISFORUM DEG2 supporte des GPU jusqu’au RTX 4090 et offre OCuLink + Thunderbolt 5. Prix : 150-300 euros sans GPU ni alimentation. Les adaptateurs open-frame (ADT-Link F9G) coûtent 30-60 euros mais exposent le GPU à nu.

Éteindre le mini PC. Insérer le GPU dans le slot PCIe x16 du dock. Connecter l’alimentation 8 broches. Relier le dock au mini PC via le câble OCuLink (SFF-8611). Allumer l’alimentation ATX en premier, puis le mini PC. Le GPU apparaît dans le gestionnaire de périphériques (Windows) ou via lspci (Linux).

Installer les drivers et configurer l’inférence

Sous Windows : installer les Studio Drivers NVIDIA (plus stables pour les charges IA). Sous Linux : utiliser les drivers propriétaires NVIDIA via apt. Vérifier avec nvidia-smi que le GPU est détecté.

Pour les GPU NVIDIA via OCuLink, le script nvidia-error43-fixer peut être nécessaire sur certaines configurations Windows. Ce problème est spécifique aux connexions eGPU et se corrige en quelques secondes. Sous Linux, aucun fix n’est requis.

Configurer Ollama : la détection CUDA est automatique. Vérifier avec ollama run llama3:8b que l’inférence utilise la VRAM du GPU externe (nvidia-smi doit montrer une utilisation VRAM). Les comparatifs de cartes edge AI aident à choisir entre OCuLink eGPU et Jetson pour chaque usage.

Quelles sont les limites de l’OCuLink et les alternatives à considérer ?

L’OCuLink n’est pas une solution universelle. Cinq contraintes méritent d’être évaluées avant d’investir dans cette architecture.

Les cinq limites techniques de l’OCuLink

Pas de hot-plug. Contrairement au Thunderbolt, l’OCuLink exige un arrêt complet du système pour connecter ou déconnecter le GPU. Cette contrainte élimine l’usage mobile.

Bande passante PCIe 4.0 x4. Les GPU haut de gamme (RTX 4090, RTX 5090) perdent 15-20 % de performances via OCuLink. Pour une RTX 3060, la pénalité est négligeable.

Alimentation externe requise. Le dock nécessite sa propre alimentation ATX. L’encombrement total dépasse celui d’un mini PC seul.

Gestion de l’arrêt. Certains mini PC ne coupent pas l’alimentation USB après l’arrêt. Les ventilateurs du GPU continuent de tourner.

Affichage sur le GPU. L’écran doit être branché directement sur le GPU externe, pas sur les ports du mini PC.

Quand préférer une autre architecture

| Besoin | Architecture recommandée | Raison |

|---|---|---|

| LLM 70B+ en local | Desktop RTX 3090/4090 ou Mac Studio | 24-128 Go VRAM/RAM unifiée |

| Inférence edge embarquée | Jetson Orin Nano Super | Compact, 25 W, CUDA natif |

| Mobilité + GPU | Thunderbolt 5 eGPU | Hot-plug, compatible laptops |

| NER CPU seul | Mini PC AMD sans eGPU | GLiNER2 ONNX tourne sur CPU |

| Budget minimal | Intel N100 + CPU inference | 180 euros, suffisant pour 7B |

L’eGPU OCuLink occupe un créneau spécifique : les utilisateurs qui possèdent ou veulent un mini PC et qui ont besoin d’accélération GPU ponctuelle ou permanente. Pour les entreprises qui envisagent l’IA comme outil de conversion via un tunnel de vente IA, cette configuration offre la puissance nécessaire à un coût maîtrisé. La dépendance aux puces NVIDIA et TSMC reste un facteur à surveiller pour la disponibilité à long terme.

Commencez par un mini PC AMD Ryzen avec OCuLink. Testez vos charges sur CPU. Si la vitesse ne suffit pas, ajoutez une RTX 3060 d’occasion. Cette approche incrémentale réduit le risque financier et vous permet de mesurer le gain réel avant d’investir.

Méthodologie

Cet article s’appuie sur les données publiées par XDA Developers, Hardware Corner, NotebookCheck et Grand View Research, consultées en avril 2026.

📞 Appelez Eric au 06 25 34 34 25

Diagnostic IA gratuit · Nous contacter · SEO & GEO automatisé

Questions fréquentes sur l’OCuLink, les eGPU et l’IA locale

L’OCuLink est-il plus rapide que Thunderbolt pour un eGPU ?

L’OCuLink (PCIe 4.0 x4, 64 Gbps) offre 60 % de bande passante brute de plus que Thunderbolt 4 (40 Gbps). En pratique, les benchmarks montrent un gain de 10 à 15 % en performances GPU et des frametimes 177 % plus stables. Thunderbolt ajoute une couche protocolaire qui réduit la bande passante effective à 22-32 Gbps. L’OCuLink fonctionne comme une connexion PCIe directe sans overhead.

Peut-on brancher une RTX 3060 en OCuLink à chaud ?

Non, l’OCuLink ne supporte pas le hot-plug. Le mini PC et l’alimentation du dock doivent être complètement éteints avant de connecter ou déconnecter le câble OCuLink (SFF-8611). Brancher le câble avec le système allumé risque d’endommager le port ou le GPU. Thunderbolt reste la seule interface eGPU compatible avec le branchement à chaud.

Combien coûte un setup complet mini PC + eGPU OCuLink ?

Un setup fonctionnel revient entre 600 et 900 euros : mini PC AMD avec OCuLink (400-500 euros pour un AOOSTAR GEM 12), RTX 3060 12 Go d’occasion (150-250 euros), adaptateur OCuLink open-frame (30-60 euros) et alimentation ATX (50-80 euros). Un dock fermé comme le MINISFORUM DEG2 (150-300 euros) remplace l’adaptateur et l’alimentation séparée.

La RTX 3060 12 Go suffit-elle pour exécuter un LLM en local ?

La RTX 3060 12 Go exécute des modèles jusqu’à 14 milliards de paramètres en quantification Q4. Les benchmarks de mars 2026 montrent 22,6 tokens/seconde sur Qwen3 14B et 678 tokens/seconde en traitement de prompt. Pour les modèles 7-8B (Llama 3, Mistral), la vitesse dépasse 40 tokens/seconde. Les modèles 30B+ nécessitent 24 Go de VRAM minimum.

Quels mini PC avec OCuLink sont les plus fiables en 2026 ?

Le GMKtec K8 Plus (Ryzen 7 8845HS, 4,4/5 sur 219 avis Amazon) et le MINISFORUM UM880 Plus offrent la meilleure combinaison fiabilité et connectique en 2026. L’AOOSTAR GEM 12 (Ryzen 9 6900HX) excelle en rapport qualité-prix avec des lignes PCIe dédiées à l’OCuLink. Vérifier que la RAM est remplaçable et non soudée pour un upgrade futur.

L’eGPU OCuLink fonctionne-t-il sous Linux pour l’IA ?

L’eGPU OCuLink fonctionne sous Linux avec les drivers propriétaires NVIDIA. Ubuntu 22.04/24.04 et Pop!_OS détectent le GPU automatiquement via lspci et le rendent disponible pour CUDA. CUDA, cuDNN et TensorRT s’installent normalement. Linux offre 10 à 15 % de performances supplémentaires par rapport à Windows pour l’inférence LLM locale. Aucun script de correction d’erreur n’est nécessaire sous Linux.

Peut-on utiliser un GPU AMD avec OCuLink pour l’IA ?

Les GPU AMD fonctionnent via OCuLink sans problème matériel. Le support logiciel ROCm pour l’IA reste inférieur à CUDA en 2026. La RX 7900 XTX (24 Go) fonctionne avec llama.cpp et Ollama sous Linux, mais certains frameworks (TensorRT, DeepStream) restent exclusifs à NVIDIA. Pour l’IA locale, NVIDIA offre la compatibilité la plus large avec les frameworks standards.

L’eGPU OCuLink est-il adapté à Stable Diffusion ?

Stable Diffusion XL exige 12 Go de VRAM minimum. La RTX 3060 12 Go via OCuLink génère des images à 5-7 itérations/seconde en résolution 512×512 avec le sampler Euler a. Le fine-tuning LoRA (DreamBooth, Kohya) fonctionne avec des batch sizes de 1-2. La pénalité OCuLink est négligeable pour la génération d’images car le calcul est intégralement GPU-bound.

Faut-il un dock fermé ou un adaptateur open-frame pour l’OCuLink ?

L’adaptateur open-frame (ADT-Link F9G, 30-60 euros) offre les mêmes performances qu’un dock fermé (MINISFORUM DEG2, 150-300 euros) à un cinquième du prix. Le dock ajoute un boîtier protecteur, des ports USB et Ethernet supplémentaires et une gestion thermique intégrée. Pour un bureau fixe à domicile, l’adaptateur suffit. Pour un environnement professionnel, le dock fermé est préférable.

L’OCuLink va-t-il évoluer vers des débits plus élevés ?

La prochaine génération OCuLink supportera PCIe 5.0 x4 (128 Gbps), doublant la bande passante actuelle. Thunderbolt 5 (80-120 Gbps) rattrape partiellement l’écart mais conserve un overhead protocolaire. Les deux standards coexisteront en 2027 : OCuLink pour les setups fixes hautes performances, Thunderbolt pour la polyvalence et la mobilité. Les premiers mini PC compatibles PCIe 5.0 OCuLink sont attendus courant 2027.