Quel mini-PC IA choisir en 2026 : Jetson Orin Nano Super, Raspberry Pi AI HAT+ et alternatives edge AI

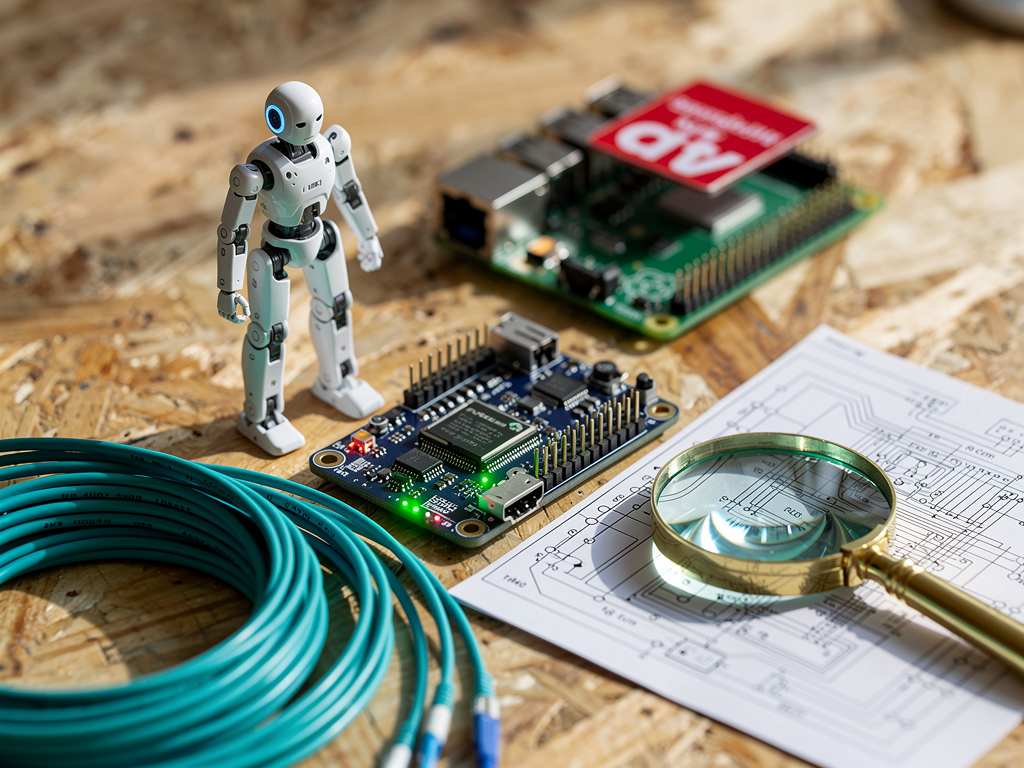

Le Jetson Orin Nano Super de NVIDIA livre 67 TOPS de puissance IA pour 249 $, soit 1,7 fois les performances de son prédécesseur à moitié prix. Le marché mondial de l’edge AI atteint 29,98 milliards de dollars en 2026 (Grand View Research, 2026). Choisir la bonne carte embarquée conditionne la réussite de tout projet robotique, vision par ordinateur ou inférence locale. Ce comparatif couvre le Jetson Orin Nano Super, le Raspberry Pi 5 avec AI HAT+, Google Coral, Axelera Metis et Xilinx Kria pour identifier la solution adaptée à chaque cas d’usage.

Temps de lecture : 14 min

À retenir

- Le Jetson Orin Nano Super double ses performances (de 40 à 67 TOPS) par une simple mise à jour logicielle, prix divisé par deux à 249 $

- Le Raspberry Pi 5 + AI HAT+ 2 (Hailo-10H) atteint 40 TOPS pour environ 175 $, alternative crédible pour la vision légère

- Le marché de l’edge AI progresse de 21,7 % par an et atteint 29,98 milliards de dollars en 2026

Pourquoi le marché de l’edge AI explose-t-il en 2026 ?

L’edge AI regroupe les systèmes qui exécutent des modèles d’intelligence artificielle directement sur l’appareil, sans envoyer les données vers le cloud. Ce traitement local réduit la latence, protège les données sensibles et fonctionne même sans connexion internet.

Des chiffres de croissance qui accélèrent chaque trimestre

Le marché mondial de l’edge AI pèse 29,98 milliards de dollars en 2026 et pourrait atteindre 118,69 milliards d’ici 2033 (Grand View Research, 2026). Le segment hardware représente 51,8 % de ce marché. L’Amérique du Nord domine avec 36 % des revenus.

Le marché de l’IA embarquée (embedded AI) atteint 13,8 milliards de dollars en 2026 et vise 42,3 milliards en 2033, avec un taux de croissance annuel de 17,3 % (Market Minds Advisory, mars 2026). 97 % des DSI américains placent l’edge AI sur leur feuille de route 2025-2026.

Les moteurs de cette adoption massive

Trois facteurs alimentent cette croissance. Le déploiement de la 5G permet aux capteurs et caméras de communiquer en temps réel avec les modules edge. La multiplication des objets connectés (plus de 150 milliards de dispositifs intelligents en circulation) génère des volumes de données impossibles à traiter dans le cloud sans latence. La réglementation sur la protection des données (RGPD en Europe, lois sectorielles aux États-Unis) pousse les entreprises à traiter l’information localement.

Les cas d’usage se multiplient : robots autonomes, drones de livraison, caméras de vidéosurveillance intelligentes, dispositifs médicaux embarqués, véhicules autonomes et automatisation industrielle. L’enjeu stratégique pour les différents secteurs d’activité est de choisir le bon matériel pour chaque application.

Quelles performances le Jetson Orin Nano Super offre-t-il vraiment ?

Le NVIDIA Jetson Orin Nano Super est un ordinateur embarqué compact conçu pour exécuter des modèles d’IA générative en local, avec 67 TOPS de puissance de calcul pour une consommation de seulement 25 watts.

La mise à jour logicielle qui a tout changé

NVIDIA a réalisé un coup stratégique rare dans l’industrie du semi-conducteur. Le Jetson Orin Nano original, lancé en mars 2023 à 499 $, livrait 40 TOPS. En décembre 2024, une mise à jour logicielle (JetPack 6.2) a débloqué un nouveau mode de puissance à 25 watts. Ce mode augmente les fréquences du GPU, de la mémoire et du processeur simultanément.

Le résultat : 67 TOPS de performance IA et 102 Go/s de bande passante mémoire (contre 68 Go/s auparavant). L’amélioration atteint 1,7 fois les performances d’inférence sur les modèles génératifs, sans aucun changement matériel. Le prix a été divisé par deux, passant de 499 $ à 249 $. Les propriétaires de l’ancienne version obtiennent les mêmes gains en installant JetPack 6.2.

Fiche technique complète du Jetson Orin Nano Super

| Caractéristique | Spécification |

|---|---|

| Performance IA | 67 TOPS (sparse), 33 TOPS (dense) |

| GPU | Ampere, 1 024 cœurs CUDA, 32 Tensor Cores, 1 020 MHz |

| CPU | 6 cœurs ARM Cortex-A78AE, 1,7 GHz |

| RAM | 8 Go LPDDR5, 102 Go/s |

| Consommation | 7 W / 15 W / 25 W (trois profils) |

| Connectique | 4x USB 3.2 (10 Gbps), 2x MIPI CSI, M.2 2280 + 2230, DisplayPort |

| Stockage | SSD NVMe ou microSD |

| OS | L4T (Linux for Tegra), JetPack 6.2+ |

| Prix | 249 $ (MSRP) |

| Support | Garanti jusqu’en 2032 |

Le Jetson Orin Nano Super exécute des modèles allant jusqu’à 8 milliards de paramètres (Llama 3.1-8B par exemple). Il gère les LLM, les VLM (vision-language models) et les Vision Transformers. Le stack logiciel NVIDIA (CUDA, TensorRT, DeepStream, Isaac ROS, Ollama, vLLM) reste identique aux plateformes data center, ce qui facilite le passage du prototype à la production.

En pratique

Un développeur qui possède déjà un Jetson Orin Nano 8 Go peut obtenir les 67 TOPS gratuitement en flashant JetPack 6.2. La procédure prend environ 30 minutes et ne nécessite aucun matériel supplémentaire. NVIDIA a également publié la feuille de route JetPack 7.1 en janvier 2026, avec le support du Jetson AGX Thor.

Comment le Raspberry Pi AI HAT+ et Google Coral se positionnent-ils face au Jetson ?

Le Raspberry Pi 5 équipé d’un AI HAT+ transforme un micro-ordinateur généraliste en station d’inférence IA, à un prix nettement inférieur au Jetson. Google Coral cible les cas d’usage ultra-basse consommation avec son Edge TPU.

Raspberry Pi 5 + AI HAT+ : l’option modulaire et accessible

Le Raspberry Pi AI HAT+ existe en trois variantes : 13 TOPS (Hailo-8L, 70 $), 26 TOPS (Hailo-8, 110 $) et le tout récent AI HAT+ 2 à 40 TOPS (Hailo-10H). Ajouté au prix du Raspberry Pi 5 (environ 65 $), l’ensemble 26 TOPS revient à 175 $, soit 30 % de moins que le Jetson.

L’intégration avec le stack caméra Raspberry Pi est native. Les applications rpicam-apps et Picamera2 détectent automatiquement le NPU Hailo et lui délèguent les tâches d’inférence. La communauté, massive (des millions d’utilisateurs actifs), fournit une documentation abondante et des tutoriels pour chaque cas d’usage.

La limite : le Raspberry Pi 5 n’a pas de GPU CUDA. Les modèles qui nécessitent TensorRT, DeepStream ou un pipeline CUDA complet ne peuvent pas tourner sur cette plateforme. Pour la détection d’objets YOLO, la segmentation sémantique ou la pose estimation, le Hailo suffit. Pour les LLM ou les VLM, le Jetson garde l’avantage.

Google Coral : la spécialiste de l’ultra-basse consommation

Le Google Coral Dev Board embarque un Edge TPU qui délivre 4 TOPS à seulement 2 watts. Le ratio performance/watt est remarquable : 2 TOPS par watt. Le Coral exécute MobileNet V2 à près de 400 images par seconde. Son prix (environ 130 $) le positionne en entrée de gamme.

Le Coral exige une quantification INT8 de tous les modèles et ne supporte que TensorFlow Lite. Cette rigidité limite les cas d’usage aux modèles légers pré-optimisés. Pour les projets IoT alimentés par batterie (capteurs de température, détecteurs de mouvement, caméras de surveillance basiques), le Coral reste imbattable en efficacité énergétique. L’évolution vers les agents IA autonomes nécessite en revanche des cartes plus puissantes.

Évaluez votre maturité IA en 5 minutes avec notre Diagnostic IA gratuit.

Quelles cartes industrielles rivalisent avec le Jetson Orin Nano Super ?

Au-delà des plateformes grand public, plusieurs fabricants proposent des solutions edge AI conçues pour des environnements industriels exigeants : chaleur, vibrations, fonctionnement continu 24/7.

Xilinx Kria : le FPGA pour les pipelines déterministes

Le Xilinx Kria KV260 (AMD) utilise un FPGA pour exécuter des pipelines de vision en temps réel avec une latence déterministe. Le FPGA permet de créer des circuits de traitement personnalisés au niveau matériel, ce que ni le GPU ni le NPU ne peuvent offrir. Les cas d’usage typiques : inspection de défauts sur ligne de production, traitement de flux caméra industriels, automatisation temps réel.

Le Kria n’apparaît pas dans les benchmarks TOPS classiques car son architecture fonctionne différemment. Sa force réside dans la stabilité thermique sous charge continue et la possibilité de certifier les designs pour les normes industrielles (ISO, IEC). En revanche, la courbe d’apprentissage est raide : programmer un FPGA exige des compétences en VHDL ou Verilog.

Axelera Metis : le challenger haute efficacité

L’Axelera Metis AIPU représente un nouvel entrant prometteur. Son architecture atteint des ratios TOPS/watt élevés, ciblant les applications de vision multi-caméras et les systèmes de surveillance intelligents à grande échelle. Les kits de développement ont commencé à être expédiés en 2024.

La maturité de la compatibilité logicielle reste inférieure à celle de NVIDIA. Les développeurs qui visent un time-to-market rapide préfèrent souvent le Jetson pour sa compatibilité avec les frameworks standards (PyTorch, TensorFlow, HuggingFace). Les équipes prêtes à investir dans l’optimisation matérielle trouvent dans Axelera une alternative crédible pour les déploiements à très grande échelle.

Synaptics Astra Machina : le nouveau venu

La série Synaptics Astra Machina Foundation, basée sur le SoC SL1680 (quad-core Cortex-A73, NPU 8 TOPS), vise le segment entrée de gamme avec un form factor similaire au Jetson Orin Nano. La documentation est de qualité, avec un modèle zoo et des dépôts GitHub prêts à l’emploi. Le positionnement cible les applications de vision peu gourmandes en puissance de calcul.

La dépendance de l’industrie envers NVIDIA et ses fournisseurs comme TSMC reste un enjeu géopolitique majeur, comme le détaille notre analyse sur la dépendance aux puces IA et la géopolitique NVIDIA-TSMC.

Comment comparer les cartes edge AI selon ses besoins ?

Un tableau comparatif factuel permet de visualiser les différences clés entre les principales plateformes edge AI disponibles en 2026. Le choix dépend du cas d’usage, du budget et de l’environnement logiciel requis.

Tableau comparatif des plateformes edge AI en 2026

| Plateforme | TOPS | Prix | Conso. | GPU CUDA | Cas d’usage principal |

|---|---|---|---|---|---|

| Jetson Orin Nano Super | 67 | 249 $ | 7-25 W | Oui (1 024) | Robotique, LLM, VLM, multi-caméras |

| Jetson AGX Orin | 275 | 1 999 $ | 15-60 W | Oui (2 048) | Autonomie avancée, multi-pipelines |

| RPi 5 + AI HAT+ 26T | 26 | ~175 $ | 5-15 W | Non | Vision, détection d’objets, prototypage |

| RPi 5 + AI HAT+ 2 40T | 40 | ~200 $ | 5-15 W | Non | LLM locaux légers, VLM, vision avancée |

| Google Coral Dev Board | 4 | ~130 $ | 2 W | Non | IoT basse conso, classification d’images |

| Xilinx Kria KV260 | Variable | ~350 $ | 10-35 W | Non (FPGA) | Vision industrielle, latence déterministe |

| Synaptics Astra SL1680 | 8 | ~100 $ | 3-8 W | Non | Vision légère, IoT, entrée de gamme |

Performance par dollar et par watt : les deux métriques qui comptent

Le Jetson Orin Nano Super affiche un ratio de 0,27 TOPS par dollar (67 TOPS / 249 $). Le Raspberry Pi 5 + AI HAT+ 26T atteint 0,15 TOPS par dollar. Le Google Coral, malgré ses 4 TOPS modestes, domine en efficacité énergétique avec 2 TOPS/watt.

Pour les projets alimentés par batterie (drones, robots mobiles, capteurs déportés), le ratio TOPS/watt prime. Pour les projets fixes avec alimentation secteur (caméras de surveillance, robots industriels, serveurs edge), le ratio TOPS/dollar et la compatibilité logicielle priment.

- Jetson Orin Nano Super : 67 TOPS, 249 $, 0,27 TOPS/$, 2,68 TOPS/W à 25 W

- RPi 5 + AI HAT+ 26T : 26 TOPS, ~175 $, 0,15 TOPS/$, ~2,6 TOPS/W à 10 W

- RPi 5 + AI HAT+ 2 40T : 40 TOPS, ~200 $, 0,20 TOPS/$, ~3,3 TOPS/W à 12 W

- Google Coral : 4 TOPS, ~130 $, 0,03 TOPS/$, 2 TOPS/W à 2 W

- Jetson AGX Orin : 275 TOPS, 1 999 $, 0,14 TOPS/$, 4,58 TOPS/W à 60 W

- Xilinx Kria KV260 : variable selon le design FPGA, ~350 $

- Synaptics Astra SL1680 : 8 TOPS, ~100 $, 0,08 TOPS/$, ~1,6 TOPS/W

En pratique

Pour un projet de caméra intelligente en magasin, le Raspberry Pi 5 + AI HAT+ 26T suffit : détection de personnes, comptage, segmentation. Pour un robot mobile autonome qui doit exécuter un modèle de navigation + un modèle de perception + un LLM embarqué, le Jetson Orin Nano Super est le seuil minimal requis.

Comment choisir sa carte edge AI pour un projet concret en 2026 ?

Le choix d’une carte edge AI repose sur cinq critères : la puissance de calcul requise, le budget, l’écosystème logiciel, la consommation énergétique et la durée de support fabricant. Voici la méthode pour arbitrer.

Arbre de décision par type de projet

Projet IoT basse consommation (capteurs, détecteurs, wearables) : Google Coral ou Synaptics Astra. Budget inférieur à 150 $, consommation inférieure à 5 W, modèles quantifiés INT8. La priorité est l’autonomie énergétique.

Vision par ordinateur standard (détection, segmentation, pose) : Raspberry Pi 5 + AI HAT+ 26T ou 40T. Budget 150-200 $, consommation 10-15 W. La communauté Raspberry Pi garantit un support logiciel pérenne et une documentation massive.

Robotique avancée, LLM embarqué, multi-caméras : Jetson Orin Nano Super. Budget 249 $, consommation 25 W max. L’accès à CUDA, TensorRT et la suite NVIDIA Isaac ROS est indispensable pour les applications robotiques complexes.

Déploiement industriel certifié : Xilinx Kria pour les pipelines déterministes ou Jetson AGX Orin pour la puissance brute. Budget 350 $ à 2 000 $. Les exigences de certification (ISO 13849, IEC 61508) orientent le choix vers des plateformes validées.

Production en volume avec contraintes d’approvisionnement : les kits tiers comme le Twowin T201 (compatibles Jetson Orin Nano) offrent une alternative avec des garanties de disponibilité industrielle. Le Jetson Orin Nano Super officiel est limité à 4 unités par compte client pour la R&D.

La compatibilité logicielle, facteur souvent sous-estimé

NVIDIA domine l’écosystème edge AI grâce à la compatibilité avec les mêmes frameworks que ses GPU data center. Un modèle développé sur un GPU A100 dans le cloud se déploie sur un Jetson sans réécriture. HuggingFace Transformers, Ollama, llama.cpp, vLLM et TensorRT-LLM fonctionnent nativement.

Le Raspberry Pi compense son absence de CUDA par une intégration native du NPU Hailo dans son stack caméra et par le support de TensorFlow Lite et PyTorch (via ONNX Runtime). Google Coral limite les développeurs à TensorFlow Lite uniquement, ce qui réduit la flexibilité.

Pour les entreprises qui souhaitent déployer des LLM en local (Qwen, DeepSeek, Llama), le Jetson Orin Nano Super représente le ticket d’entrée le plus accessible. Le GTC 2026 de NVIDIA a confirmé l’orientation vers l’IA physique et les agents autonomes, renforçant la feuille de route Jetson à long terme.

| Critère | Jetson Orin Nano Super | RPi 5 + AI HAT+ | Google Coral |

|---|---|---|---|

| LLM embarqué (8B params) | Oui | Limité (HAT+ 2 uniquement) | Non |

| YOLO v8 temps réel | Oui (30+ FPS) | Oui (via Hailo) | Limité |

| Multi-caméras simultanées | 2 MIPI CSI + USB | 1 MIPI CSI + USB | 1 caméra |

| Frameworks supportés | PyTorch, TF, ONNX, TensorRT, vLLM | TFLite, PyTorch (ONNX), Hailo SDK | TFLite uniquement |

| Communauté | Large (NVIDIA Developer) | Massive (millions) | Modérée |

| Support fabricant | Jusqu’en 2032 | Long terme (RPi Foundation) | Incertain |

La création d’un produit edge AI performant ne se limite pas au choix du matériel. L’architecture logicielle, le pipeline de données et l’intégration avec les outils existants déterminent le succès du projet. Pour les entreprises qui débutent, un guide de déploiement d’agents IA aide à structurer la démarche. Lancez un audit de vos besoins cette semaine en utilisant le Jetson AI Lab de NVIDIA ou le Model Zoo Hailo de Raspberry Pi.

Méthodologie

Cet article s’appuie sur les données publiées par Grand View Research, Market Minds Advisory, NVIDIA Developer Blog et Raspberry Pi Documentation, consultées en avril 2026. Les prix mentionnés correspondent aux tarifs fabricant (MSRP) en vigueur au moment de la rédaction.

📞 Appelez Eric au 06 25 34 34 25

Diagnostic IA gratuit · Nous contacter · SEO & GEO automatisé

Questions fréquentes sur le Jetson Orin Nano Super et l’edge AI

Le Jetson Orin Nano Super est-il deux fois plus rapide que l’ancien modèle ?

Le Jetson Orin Nano Super délivre 67 TOPS contre 40 TOPS pour la version précédente, soit un gain de 1,7 fois en inférence IA générative. Le gain varie de 1,37x à 2,04x selon le type de modèle : les modèles de vision bénéficient du plus fort gain (jusqu’à 2,04x), les LLM gagnent entre 1,37x et 1,63x. La mise à jour est purement logicielle via JetPack 6.2, sans changement matériel.

Combien coûte un Jetson Orin Nano Super en 2026 ?

Le Jetson Orin Nano Super coûte 249 $ au tarif fabricant (MSRP). Ce prix représente une division par deux par rapport aux 499 $ du modèle original lancé en mars 2023. Sur Amazon, les prix peuvent fluctuer en raison de la forte demande. Les distributeurs officiels (Arrow, DigiKey, Seeed Studio) respectent le prix MSRP avec des délais de livraison variables.

Peut-on exécuter un LLM sur le Jetson Orin Nano Super ?

Le Jetson Orin Nano Super exécute des modèles allant jusqu’à 8 milliards de paramètres (Llama 3.1-8B, Mistral 7B, Gemma 2-7B). Les frameworks Ollama, llama.cpp, vLLM et TensorRT-LLM sont compatibles nativement. La bande passante mémoire de 102 Go/s et les 8 Go de RAM LPDDR5 constituent les facteurs limitants pour les modèles plus volumineux.

Le Raspberry Pi 5 avec AI HAT+ peut-il remplacer un Jetson pour la vision ?

Le Raspberry Pi 5 équipé d’un AI HAT+ 26 TOPS (Hailo-8) gère la détection d’objets YOLO, la segmentation sémantique et la pose estimation en temps réel. Pour les projets mono-caméra de vision standard, il constitue une alternative viable à 175 $. Le Jetson reste nécessaire pour les pipelines multi-caméras, les LLM embarqués et les applications CUDA intensives.

Google Coral est-il toujours pertinent face au Jetson et au Raspberry Pi ?

Google Coral reste pertinent pour les applications IoT ultra-basse consommation (2 watts). Son Edge TPU délivre 4 TOPS en INT8, suffisant pour MobileNet, EfficientNet et les modèles de classification légers. Pour les projets alimentés par batterie où chaque milliwatt compte, aucune alternative n’offre ce ratio performance/watt. En revanche, Coral est inadapté aux LLM, VLM et modèles PyTorch.

Quelle carte edge AI choisir pour un robot autonome ?

Un robot autonome nécessite simultanément un modèle de navigation, un modèle de perception et souvent un LLM pour l’interaction vocale. Le Jetson Orin Nano Super (67 TOPS, CUDA, Isaac ROS) représente le minimum requis pour cette charge multi-modèles. Les robots avancés avec lidar, multi-caméras et manipulation utilisent le Jetson AGX Orin (275 TOPS). Le Raspberry Pi convient uniquement aux robots éducatifs mono-tâche.

Le Jetson Orin Nano Super est-il adapté à la production industrielle ?

NVIDIA limite l’achat du kit développeur à 4 unités par compte pour la R&D. Pour la production en volume, NVIDIA propose des modules Jetson Orin Nano vendus séparément, intégrables sur des carrier boards personnalisées. Des fabricants tiers comme Twowin (T201) ou Forecr proposent des alternatives industrielles avec des garanties de disponibilité et de durabilité renforcées.

Comment mettre à jour un ancien Jetson Orin Nano vers la version Super ?

La mise à jour s’effectue en flashant JetPack 6.2 ou une version ultérieure sur le Jetson Orin Nano 8 Go existant. La procédure utilise le SDK Manager de NVIDIA sur un PC Linux hôte. Le nouveau mode de puissance à 25 watts s’active ensuite dans les paramètres nvpmodel. Aucun matériel supplémentaire n’est requis : les 67 TOPS sont accessibles via un simple changement logiciel.

Quel est le marché de l’edge AI en 2026 ?

Le marché mondial de l’edge AI atteint 29,98 milliards de dollars en 2026 et devrait croître à 21,7 % par an jusqu’en 2033 pour atteindre 118,69 milliards de dollars. Le segment hardware représente 51,8 % du marché. L’Amérique du Nord concentre 36 % des revenus. Le manufacturing affiche le taux de croissance le plus rapide à 23 % par an.

Le Raspberry Pi AI HAT+ 2 à 40 TOPS change-t-il la donne face au Jetson ?

Le Raspberry Pi AI HAT+ 2 (Hailo-10H, 40 TOPS) rapproche le Raspberry Pi des performances du Jetson Orin Nano original (40 TOPS) pour environ 200 $. Il ajoute le support des LLM et VLM locaux légers. Le Jetson Orin Nano Super conserve son avance en TOPS bruts (67 vs 40), en GPU CUDA (1 024 cœurs) et en infrastructure robotique (Isaac ROS, DeepStream).