Gouvernance IA en Entreprise : Framework Complet pour Dirigeants et Conseils d’Administration en 2026

En 2026, 50 % des CEO estiment que leur stabilité professionnelle dépend de la réussite de l’intégration de l’IA dans leur organisation. Pourtant, 60 % d’entre eux admettent avoir intentionnellement ralenti l’implémentation par crainte d’erreurs et de dysfonctionnements. Entre l’AI Act européen dont les obligations à haut risque entrent en vigueur le 2 août 2026, la prolifération du shadow AI et la pression des investisseurs, la gouvernance IA n’est plus un sujet de direction informatique : c’est une responsabilité de conseil d’administration. Ce guide opérationnel détaille le framework complet pour structurer une gouvernance IA efficace, de la cartographie des usages à la mise en conformité réglementaire.

Qu’est-ce que la gouvernance IA en entreprise ?

La gouvernance IA désigne l’ensemble des structures, processus et mécanismes de surveillance nécessaires au développement et au déploiement responsables des systèmes d’intelligence artificielle dans une organisation. Elle aligne les personnes, les processus et la technologie pour garantir que l’IA produit de la valeur tout en maîtrisant les risques.

Concrètement, la gouvernance IA recouvre plusieurs dimensions interdépendantes. Les rôles et responsabilités définissent qui décide, qui supervise et qui rend des comptes sur les projets IA. Les politiques d’usage encadrent ce qui est autorisé, interdit ou soumis à validation. La gestion des risques identifie et atténue les dangers liés aux biais algorithmiques, à la protection des données, à la cybersécurité et à la conformité réglementaire. Enfin, la mesure de la performance permet de vérifier que les investissements IA produisent un retour mesurable.

La différence entre les entreprises qui réussissent leur transformation IA et celles qui stagnent réside rarement dans la technologie. Selon le BCG AI Radar 2026, 60 % des organisations ne génèrent aucune valeur matérielle de leurs investissements IA malgré des budgets en forte hausse, et seulement 5 % créent de la valeur substantielle à l’échelle. L’absence de gouvernance formelle est identifiée comme l’obstacle principal. Les organisations qui opérationnalisent la transparence et la sécurité de l’IA constatent une augmentation de 50 % de l’adoption et de l’acceptation par les utilisateurs, selon Gartner. Pour les entreprises qui cherchent à comprendre comment structurer concrètement cette transformation, notre guide des questions clés pour dirigeants face à l’IA constitue un point de départ éclairant.

| Dimension | Sans gouvernance | Avec gouvernance |

|---|---|---|

| Visibilité sur les usages IA | Shadow AI non détecté | Inventaire centralisé et audité |

| Conformité réglementaire | Exposition aux sanctions (jusqu’à 35 M€) | Preuves de conformité documentées |

| ROI des investissements IA | 60 % sans valeur matérielle | +50 % d’adoption utilisateurs |

| Responsabilité juridique | Floue, dispersée | Rôles définis, traçabilité complète |

| Confiance parties prenantes | Opacité algorithmique | Transparence vérifiable |

Pourquoi 2026 est l’année charnière pour la gouvernance IA

Trois forces convergentes font de 2026 le moment où la gouvernance IA passe du statut de bonne pratique à celui d’obligation stratégique et réglementaire. Les entreprises qui n’agissent pas maintenant s’exposent à des risques financiers, juridiques et concurrentiels majeurs.

L’AI Act européen : le compte à rebours réglementaire

Le règlement européen sur l’intelligence artificielle entre dans sa phase opérationnelle décisive. Depuis février 2025, les pratiques IA jugées inacceptables sont interdites (scoring social, manipulation subliminale). Depuis août 2025, les obligations sur les modèles d’IA à usage général sont applicables. Et le 2 août 2026, les obligations pour les systèmes à haut risque entrent en vigueur : traçabilité, transparence, supervision humaine, robustesse technique, marquage CE obligatoire et inscription dans la base de données européenne. Les sanctions atteignent 35 millions d’euros ou 7 % du chiffre d’affaires mondial pour les infractions les plus graves. Or, la majorité des PME et ETI européennes n’ont pas encore désigné de responsable de conformité IA ni engagé d’évaluation formelle.

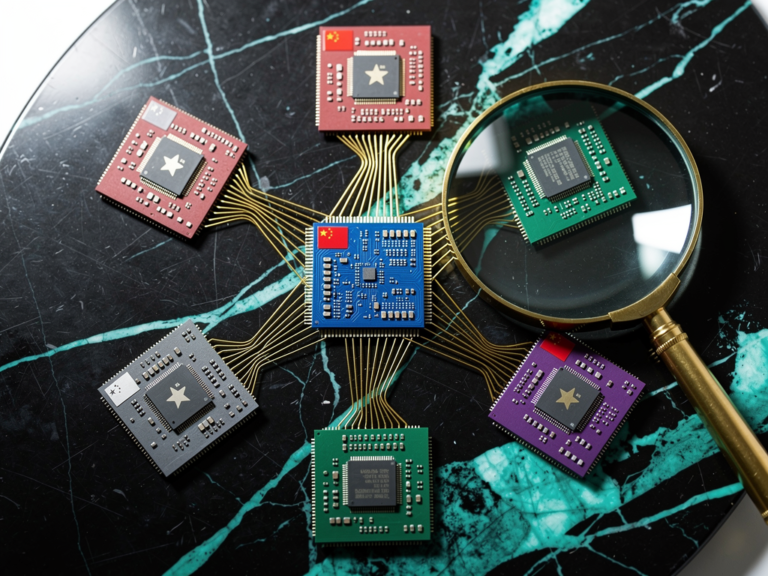

Le shadow AI : la bombe à retardement

Le shadow AI — l’utilisation non déclarée d’outils d’intelligence artificielle par les collaborateurs — représente un risque organisationnel considérable. Des employés utilisent ChatGPT, Gemini ou Claude pour rédiger des documents, analyser des données clients ou préparer des décisions sans que la direction en soit informée. Ces usages non encadrés exposent l’entreprise à des fuites de données sensibles, à des violations du RGPD et à des décisions basées sur des informations non vérifiées. L’AI Act exige désormais que chaque usage d’IA soit cartographié et documenté — ce qui rend le shadow AI non seulement risqué mais potentiellement illégal. Pour les professions soumises au secret professionnel, les enjeux sont encore plus critiques, comme le détaille notre analyse sur le secret professionnel et l’IA pour les avocats.

La pression des investisseurs et la compétition

Selon le BCG AI Radar 2026, 72 % des CEO sont désormais le décideur principal en matière d’IA, soit le double de l’année précédente. Les entreprises prévoient de doubler leurs dépenses IA pour atteindre 1,7 % de leur chiffre d’affaires. Plus de la moitié des non-CEO estiment que le dirigeant ou le conseil d’administration devrait démissionner si l’entreprise perd des parts de marché à cause d’une stratégie IA inadaptée. La gouvernance IA n’est plus un sujet technique : c’est un enjeu de légitimité du leadership. Les secteurs d’activité les plus exposés — santé, finance, recrutement, éducation — sont aussi ceux où les obligations réglementaires sont les plus strictes.

| Échéance AI Act | Date | Obligations | Sanctions |

|---|---|---|---|

| Pratiques interdites | 2 février 2025 ✅ | Scoring social, manipulation, biométrie temps réel | 35 M€ ou 7 % CA |

| Modèles GPAI | 2 août 2025 ✅ | Documentation technique, transparence | 15 M€ ou 3 % CA |

| Systèmes haut risque | 2 août 2026 ⏳ | Marquage CE, traçabilité, supervision humaine, gestion des risques | 15 M€ ou 3 % CA |

| Produits réglementés | 2 août 2027 | Intégration complète systèmes existants | 15 M€ ou 3 % CA |

Les 4 étapes d’un framework de gouvernance IA opérationnel

Construire une gouvernance IA ne nécessite pas un programme de transformation de 18 mois. Les frameworks les plus efficaces suivent une logique progressive en quatre étapes, validée par les retours d’expérience des grands cabinets de conseil et adaptable à toute taille d’entreprise.

Étape 1 — Cartographier l’IA existante et auditer le shadow AI

Avant de gouverner, il faut savoir ce qui existe. La première action consiste à recenser exhaustivement tous les systèmes et outils d’IA utilisés dans l’organisation, y compris — et surtout — ceux adoptés de manière informelle par les collaborateurs. Cette cartographie doit couvrir les outils intégrés aux logiciels métiers (CRM avec scoring prédictif, ERP avec prévisions automatisées), les outils d’IA générative utilisés individuellement (ChatGPT, Claude, Gemini, Copilot), les automatisations internes (scripts, bots, workflows IA) et les services tiers intégrant de l’IA (plateformes marketing, outils RH, solutions financières). Pour chaque usage identifié, documentez le type de données traitées, le niveau de risque selon la classification AI Act, le responsable métier et la finalité opérationnelle. Les entreprises qui utilisent des outils d’anonymisation des données avant de les soumettre à l’IA réduisent considérablement leur exposition aux risques RGPD.

Étape 2 — Structurer le comité IA et les responsabilités

La gouvernance sans responsabilité définie est un exercice théorique. Même dans une PME, un comité IA — même restreint — doit être constitué. Sa composition minimale inclut un représentant de la direction générale (sponsor exécutif), un responsable métier (cas d’usage et valeur), un responsable IT ou data (architecture et sécurité), un référent conformité (RGPD et AI Act) et un représentant RH (accompagnement au changement et formation). Ce comité se réunit mensuellement pour arbitrer les priorités, suivre les risques, encadrer l’usage des outils IA grand public et structurer la montée en compétences. Selon Bpifrance, 73 % des projets IA en PME-ETI sont impulsés par le dirigeant — ce qui rend le sponsorship de la direction générale indispensable au succès du comité.

Étape 3 — Définir les protocoles de gestion des risques

Chaque système IA identifié doit faire l’objet d’une analyse de risques structurée. Le protocole inclut la classification du système selon les quatre niveaux de l’AI Act (inacceptable, haut risque, risque limité, risque minimal), l’évaluation des impacts potentiels sur les droits fondamentaux et la sécurité, la mise en place de garde-fous techniques (filtrage des entrées/sorties, contrôle humain des décisions critiques, journalisation des interactions) et la documentation des mesures d’atténuation. Pour les systèmes à haut risque — recrutement IA, scoring crédit, évaluation des collaborateurs — les obligations sont maximales : documentation technique complète, système de gestion de la qualité, marquage CE et déclaration de conformité UE. Le coût de la mise en conformité est très inférieur à celui d’une sanction : jusqu’à 15 millions d’euros ou 3 % du chiffre d’affaires mondial pour les systèmes à haut risque non conformes.

Étape 4 — Piloter, mesurer et itérer

La gouvernance IA n’est pas un projet à livrer puis à oublier. C’est un processus continu qui nécessite des indicateurs de pilotage clairs : nombre d’usages IA inventoriés vs estimés, taux de conformité AI Act par catégorie de risque, ROI des projets IA validés par le comité, incidents détectés (fuites de données, biais, hallucinations), niveau de formation IA des collaborateurs. Le reporting trimestriel au conseil d’administration est une bonne pratique qui aligne la gouvernance IA avec la gouvernance d’entreprise globale. Les CEO « pionniers » identifiés par le BCG consacrent plus de 8 heures par semaine à leur propre formation IA et investissent 60 % de leur budget IA dans la montée en compétences de leurs équipes. Les entreprises qui souhaitent automatiser ce suivi peuvent s’appuyer sur les workflows décrits dans notre page SEO et GEO automatisé, qui illustrent les principes d’automatisation appliqués au marketing.

Tableau comparatif : les frameworks BCG, Deloitte, PwC et Databricks

Plusieurs frameworks de gouvernance IA font référence à l’échelle mondiale. Chacun apporte un angle différent — stratégique, opérationnel ou technique — et leur complémentarité permet de construire un dispositif adapté à la maturité de chaque organisation.

| Critère | BCG AI Radar | Deloitte TrustWorthy AI | PwC Responsible AI | Databricks DAGF |

|---|---|---|---|---|

| Focus principal | Stratégie CEO et ROI | Confiance et éthique | Responsabilité et risques | Technique et scalabilité |

| Archétypes dirigeants | 3 profils (Suiveurs, Pragmatistes, Pionniers) | 3 catégories de maturité IA | Niveaux de maturité par dimension | 8 niveaux de gouvernance technique |

| Rôle du conseil d’administration | CEO pilote, board supervise | Board intégré au processus d’approbation | 35 % des boards supervisent déjà l’IA | Rôle technique, moins de gouvernance board |

| Gestion des risques | Intégrée à la stratégie globale | Framework dédié robuste | Règle 20/80 (tech vs organisation) | Contrôles automatisés, métadonnées actives |

| Adapté aux PME/ETI | Partiellement (focus grandes entreprises) | Partiellement | Oui (approche modulaire) | Non (infrastructure technique avancée) |

| Conformité AI Act | Mentionnée, non détaillée | Alignement partiel | Alignement fort | Alignement technique |

Le BCG AI Radar 2026 apporte une vision stratégique précieuse, centrée sur le rôle du CEO et les archétypes de leadership. Son analyse révèle que les entreprises « pionnières » — seulement 15 % du total — investissent deux fois plus dans la formation de leurs équipes et déploient les agents IA de bout en bout. En revanche, 70 % des CEO sont des « pragmatistes » qui n’investissent que lorsqu’ils voient une valeur évidente, et 15 % restent des « suiveurs » prudents.

Le framework Deloitte se distingue par sa structuration en trois catégories d’IA selon le niveau de risque et sa méthodologie d’évaluation de la confiance. Le framework PwC insiste sur une réalité fondamentale : la technologie ne représente que 20 % de la valeur d’un projet IA, les 80 % restants proviennent de la réorganisation du travail et des processus. Quant au Databricks AI Governance Framework (DAGF), il propose un modèle à huit niveaux particulièrement adapté aux organisations techniquement matures, avec des environnements sandbox et des déploiements pilotes contrôlés.

Pour une PME ou ETI française, la recommandation est de combiner l’approche stratégique du BCG (leadership et upskilling), la méthodologie de risques du PwC (focus sur l’organisation plus que sur la technologie) et la conformité AI Act comme fil conducteur transversal. Les entreprises souhaitant évaluer rapidement leur maturité IA peuvent commencer par notre Diagnostic IA gratuit, qui identifie les axes de progrès prioritaires en quelques minutes.

Charte IA : modèle opérationnel pour PME et ETI françaises

Une charte IA n’est pas un document juridique de cent pages. C’est un cadre opérationnel clair qui définit les règles d’utilisation de l’intelligence artificielle dans l’entreprise, compréhensible par tous les collaborateurs et applicable immédiatement.

La charte IA d’une PME ou ETI française doit couvrir cinq volets essentiels. Le premier volet, périmètre et usages autorisés, liste explicitement les outils IA validés par l’entreprise, les cas d’usage approuvés par le comité IA et les pratiques interdites (soumission de données clients à des IA publiques sans anonymisation, prise de décision automatisée sans supervision humaine dans les domaines à haut risque). Le deuxième volet, données et confidentialité, précise quelles données peuvent être soumises à quels outils, comment les données sont anonymisées ou pseudonymisées avant traitement, et comment la conformité RGPD est maintenue. Ce volet est particulièrement critique pour les entreprises qui travaillent avec des données sensibles — notre article sur la souveraineté des données et les LLM approfondit ces enjeux.

Le troisième volet, responsabilités, attribue un propriétaire métier à chaque cas d’usage IA et définit la chaîne de validation pour les nouveaux usages. Le quatrième volet, formation et compétences, prévoit un plan de montée en compétences pour tous les collaborateurs — pas seulement les équipes techniques. Le BCG révèle que lorsqu’un dirigeant utilise personnellement l’IA générative, l’entreprise est cinq fois plus susceptible de l’adopter à l’échelle (46 % contre 9 %). Le cinquième volet, contrôle et amélioration, définit les métriques de suivi, la fréquence des audits et le processus de révision de la charte.

| Volet de la charte | Contenu clé | Responsable | Fréquence de révision |

|---|---|---|---|

| Périmètre et usages | Liste outils validés, cas d’usage approuvés, interdictions | Comité IA | Trimestrielle |

| Données et confidentialité | Classification données, protocoles d’anonymisation, conformité RGPD | DPO / Référent conformité | Semestrielle |

| Responsabilités | Propriétaire par cas d’usage, chaîne de validation | Direction générale | Annuelle |

| Formation | Plan de montée en compétences, objectifs par profil | RH + Comité IA | Semestrielle |

| Contrôle et amélioration | KPI, audits, processus de mise à jour | Comité IA + Audit | Trimestrielle |

Piloter et itérer : métriques, reporting et amélioration continue

La gouvernance IA produit de la valeur uniquement si elle est pilotée par des indicateurs concrets et revue régulièrement. Les entreprises qui traitent la gouvernance comme un projet ponctuel échouent invariablement — celles qui l’inscrivent dans un cycle d’amélioration continue en font un avantage compétitif durable.

Le tableau de bord d’une gouvernance IA efficace repose sur cinq catégories de métriques. Les métriques de couverture mesurent le pourcentage d’usages IA inventoriés par rapport au nombre estimé, le taux de collaborateurs formés et le nombre de cas d’usage validés par le comité IA. Les métriques de conformité suivent l’avancement de la mise en conformité AI Act par catégorie de risque, le nombre de systèmes à haut risque documentés et le statut du marquage CE. Les métriques de valeur quantifient le ROI des projets IA approuvés, les gains de productivité mesurés et la satisfaction des utilisateurs internes. Les métriques de risque comptabilisent les incidents détectés (fuites de données, biais identifiés, hallucinations impactantes), les écarts de conformité et les alertes shadow AI. Enfin, les métriques de maturité évaluent la progression sur une échelle de maturité (initial, structuré, optimisé, transformé).

Le reporting au conseil d’administration doit être trimestriel et synthétique. Un format efficace tient sur deux pages : un tableau de bord visuel avec les indicateurs clés et un commentaire narratif sur les décisions à prendre. Les CEO « pionniers » du BCG intègrent ce reporting dans leur gouvernance d’entreprise globale, au même titre que le reporting financier ou RSE. Cette approche transforme la gouvernance IA d’un centre de coût en un levier de différenciation stratégique.

Les entreprises les plus avancées utilisent des outils d’automatisation pour collecter et consolider ces métriques. Des plateformes comme Prompts.ai offrent une surveillance centralisée de 35 modèles d’IA avec une conformité SOC 2 Type II. D’autres, comme Stack AI, proposent un modèle de gouvernance à huit niveaux avec plafonds de jetons pour le contrôle budgétaire. Pour une PME qui souhaite commencer simplement, un tableur structuré mis à jour mensuellement est un premier pas parfaitement valide. Ce qui compte, c’est la régularité du suivi et l’engagement de la direction. Pour les organisations qui veulent aller plus loin dans l’automatisation de leurs processus marketing et SEO, notre page création de site web illustre comment l’IA peut être intégrée dès la conception technique.

| Profil CEO (BCG 2026) | Part | Budget formation IA | Effectif formé | Temps perso IA/semaine |

|---|---|---|---|---|

| Pionniers | ~15 % | 60 % du budget IA | +65 % | +8h |

| Pragmatistes | ~70 % | 27 % du budget IA | ~30 % | Variable |

| Suiveurs | ~15 % | 24 % du budget IA | ~15 % | Faible |

Questions fréquentes sur la gouvernance IA en entreprise

Qu’est-ce que la gouvernance IA en entreprise ?

La gouvernance IA désigne l’ensemble des structures, politiques, processus et mécanismes de contrôle qu’une organisation met en place pour encadrer le développement, le déploiement et l’utilisation de ses systèmes d’intelligence artificielle. Elle couvre la définition des rôles et responsabilités, la gestion des risques, la conformité réglementaire (AI Act, RGPD), la transparence des décisions algorithmiques et la mesure du retour sur investissement. Son objectif est de garantir que l’IA produit de la valeur business tout en respectant les exigences éthiques, juridiques et sociétales.

Pourquoi la gouvernance IA est-elle devenue urgente en 2026 ?

Trois facteurs convergent. D’abord, l’AI Act européen impose des obligations contraignantes sur les systèmes IA à haut risque à partir du 2 août 2026, avec des sanctions pouvant atteindre 35 millions d’euros ou 7 % du chiffre d’affaires mondial. Ensuite, le shadow AI — l’usage non encadré d’outils IA par les collaborateurs — expose les entreprises à des fuites de données et des violations réglementaires. Enfin, 72 % des CEO sont désormais les décideurs principaux en matière d’IA et la moitié estiment que leur stabilité professionnelle en dépend.

Comment structurer un comité IA dans une PME ?

Un comité IA de PME peut être constitué de cinq personnes : un représentant de la direction générale qui sponsorise le programme, un responsable métier qui identifie les cas d’usage à valeur ajoutée, un référent IT ou data qui gère l’architecture et la sécurité, un responsable conformité (DPO ou référent RGPD) et un représentant RH pour le volet formation. Ce comité se réunit mensuellement pour arbitrer les priorités, valider les nouveaux usages et suivre les indicateurs de performance et de conformité. L’essentiel est la régularité et l’engagement de la direction, pas la taille du comité.

Qu’est-ce que le shadow AI et comment le détecter ?

Le shadow AI désigne l’utilisation non déclarée et non autorisée d’outils d’intelligence artificielle par les collaborateurs d’une entreprise. Il se manifeste par l’usage de ChatGPT, Claude, Gemini ou d’autres outils IA pour traiter des données de l’entreprise sans validation de la direction ni protocole de sécurité. Pour le détecter, les entreprises peuvent auditer les flux réseau, mener des enquêtes internes anonymes, analyser les licences SaaS non répertoriées et mettre en place une politique claire d’usage des outils IA avec un canal de déclaration simple.

Quels sont les frameworks de gouvernance IA les plus reconnus ?

Les quatre frameworks majeurs en 2026 sont le BCG AI Radar (focus stratégie CEO et ROI, trois archétypes de dirigeants), le Deloitte Trustworthy AI Framework (confiance et éthique, trois catégories de maturité), le PwC Responsible AI Toolkit (responsabilité et risques, règle 20/80 technologie vs organisation) et le Databricks AI Governance Framework (modèle technique à huit niveaux). Pour une PME française, la recommandation est de combiner l’approche stratégique du BCG avec la méthodologie de risques du PwC et la conformité AI Act comme cadre transversal.

Combien coûte la mise en place d’une gouvernance IA pour une PME ?

Le coût varie selon la taille et la complexité de l’organisation. Pour une PME de 20 à 100 salariés, la mise en place initiale (cartographie, charte, comité, premiers protocoles) peut se faire en interne avec un investissement de 10 000 à 30 000 € en temps et en accompagnement externe ponctuel. Pour une ETI avec des systèmes à haut risque nécessitant une conformité AI Act complète (marquage CE, documentation technique, évaluation de conformité), le budget peut atteindre 50 000 à 150 000 €. Dans tous les cas, ce coût est très inférieur aux sanctions potentielles et aux pertes liées à une absence de gouvernance.

Diag IA gratuit

Nous contacter

Parler à Eric