Comment créer des vidéos avec Claude Code et Remotion en 2026 : le guide complet des outils vidéo IA

Remotion cumule 28 000 étoiles sur GitHub et 400 000 téléchargements mensuels sur npm. Combiné à Claude Code, ce framework open source permet de produire des vidéos professionnelles en décrivant le résultat souhaité en langage naturel, sans ouvrir After Effects ni recruter un monteur. Le marché de la vidéo IA a basculé en 2026 : Sora ferme ses portes, Kling 3.0 génère des clips de 3 minutes à 7 $ par mois, et des plateformes comme Higgsfield agrègent plus de 15 modèles dans un seul espace de travail. Ce guide couvre la création programmatique avec Remotion, le panorama complet des générateurs vidéo IA, et les retours d’expérience terrain pour intégrer ces outils dans une stratégie de contenu.

Temps de lecture : 15 min

À retenir

- Remotion Skills, lancé en janvier 2026, a dépassé 30 000 installations hebdomadaires et 6 millions de vues sur sa démo de lancement

- Le couple Claude Code + Remotion réduit la production d’une vidéo motion design de plusieurs heures à moins de 10 minutes

- Le marché compte trois catégories d’outils : générateurs cinématiques (Kling, Runway, Veo), plateformes d’avatars (HeyGen, Synthesia) et production programmatique (Remotion + Claude Code)

- Les coûts de production vidéo IA ont chuté de 70 à 90 % par rapport à la production traditionnelle en 2026

Comment Claude Code et Remotion permettent-ils de créer des vidéos par le code ?

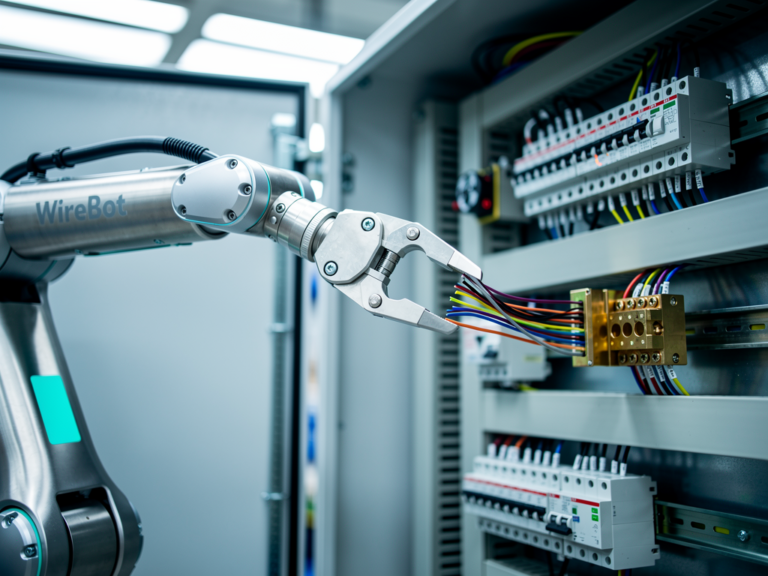

Remotion est un framework open source qui transforme la production vidéo en tâche de développement. Il utilise React pour générer chaque frame d’une vidéo, puis FFmpeg pour l’encoder en MP4. Associé à Claude Code, l’outil en ligne de commande agentique d’Anthropic, il permet de décrire une vidéo en français ou en anglais et d’obtenir le fichier rendu en quelques minutes.

Le fonctionnement de Remotion : React au service de la vidéo

Remotion traite une vidéo comme une application React qui s’exécute frame par frame. Le développeur accède au numéro de frame en cours via le hook useCurrentFrame() et contrôle les animations avec des fonctions comme interpolate() et spring(). Le framework gère le bundling via Webpack, la transpilation via Babel, et l’encodage via FFmpeg.

Le projet a été créé par Jonny Burger et atteint aujourd’hui 28 000 étoiles GitHub avec plus de 400 000 téléchargements npm mensuels (GitHub Remotion). Les cas d’usage couvrent les vidéos marketing, les visualisations de données animées, les démos produit, les tutoriels et les contenus réseaux sociaux personnalisés à grande échelle.

En pratique

Pour démarrer un projet Remotion : npm init video, puis npm start pour prévisualiser à localhost:3000. Le rendu final se lance avec npm run build. L’ensemble des technologies web (CSS, Canvas, SVG, WebGL) est exploitable dans les compositions vidéo.

Remotion Skills + Claude Code : la vidéo par conversation

Remotion Skills est une couche de compétences optimisée pour les agents IA, lancée en janvier 2026. Elle enseigne à Claude Code comment générer du code Remotion correct : hooks, interpolations, séquençage, transitions. La démo de lancement a dépassé 6 millions de vues, et le package remotion-best-practices a atteint 30 000 installations hebdomadaires dès la première semaine (Remotion Skills).

Le workflow est direct. L’utilisateur tape dans Claude Code : « Crée une vidéo de 30 secondes avec le logo animé, trois fonctionnalités mises en avant et un appel à l’action final. » Claude génère le code React/TypeScript, Remotion le rend en MP4. Le résultat s’affiche en prévisualisation dans le navigateur avant le rendu définitif.

Des Skills complémentaires enrichissent le processus. Le Claude Code Video Toolkit propose 9 composants réutilisables (titres, transitions, lower thirds), un système de thèmes et des profils de marque. Un autre Skill, Video Director, ajoute une couche créative avec un processus en 4 phases : réflexion, design, construction, revue. Les équipes combinent plusieurs Skills pour orchestrer la recherche d’assets, la génération de voix off et le montage final dans un seul prompt.

Remotion excelle pour les vidéos paramétriques et le batch rendering. Un seul template peut produire des centaines de vidéos personnalisées à partir d’une base de données, avec versioning Git et automatisation complète. La limite : Remotion ne remplace pas un éditeur non linéaire pour le montage de footage existant. Il crée des vidéos à partir de code, pas à partir de rushes.

Quels sont les meilleurs générateurs vidéo IA cinématiques en 2026 ?

Les générateurs vidéo IA cinématiques transforment un prompt texte ou une image en séquence vidéo réaliste. Trois acteurs dominent le segment en 2026 : Kling 3.0 pour le rapport qualité-prix, Runway Gen-4.5 pour le contrôle créatif, et Google Veo 3.1 pour le réalisme physique.

Kling 3.0 : le meilleur rapport volume-coût

Kling 3.0, développé par Kuaishou, a lancé en février 2026 une refonte architecturale complète. Le modèle utilise un framework d’entraînement multimodal unifié qui traite texte, image, audio et vidéo dans un seul système. Les clips atteignent 3 minutes en 1080p à 30 fps, avec un contrôle de caméra fiable (dolly, pan, orbite).

Le plan Standard commence à 7 $ par mois pour 660 crédits, ce qui positionne Kling comme l’option la plus abordable pour les créateurs qui produisent en volume (Kling AI). Les simulations physiques (eau, fumée, tissu) surpassent la concurrence à ce niveau de prix. La plateforme a dépassé 10 millions de vidéos générées depuis son lancement.

Runway Gen-4.5 et Google Veo 3.1 : le haut de gamme

Runway Gen-4.5 se distingue par son intégration dans les workflows de post-production professionnels. Les motion brushes permettent de diriger précisément quelles parties de l’image doivent bouger. Le plan Standard démarre à 12 $ par mois avec 625 crédits. Runway s’adresse aux cinéastes et producteurs qui utilisent l’IA comme composant d’un pipeline existant, pas comme remplacement.

Google Veo 3.1 atteint le meilleur score en réalisme physique : les interactions entre objets, la lumière et les mouvements corporels sont les plus convaincants du marché. L’accès gratuit via Gemini (sans watermark) en fait la meilleure option de test. Le plan Google AI Pro coûte 19,99 $ par mois.

| Outil | Durée max | Prix entrée | Point fort |

|---|---|---|---|

| Kling 3.0 | 3 min | 6,99 $/mois | Volume et physique réaliste |

| Runway Gen-4.5 | 10 s | 12 $/mois | Contrôle créatif, post-production |

| Google Veo 3.1 | 8 s | Gratuit (Gemini) | Réalisme physique, pas de watermark |

| Pika 2.5 | 10 s | 8 $/mois | Effets créatifs, lip sync |

| Luma Ray 3.14 | Variable | 7,99 $/mois | Itération rapide, 4K HDR |

Le fait marquant de 2026 : OpenAI a annoncé la fermeture de Sora le 24 mars 2026. L’application, l’API et le partenariat Disney ont été abandonnés six mois après le lancement. Les utilisateurs ont jusqu’au 26 avril pour exporter leurs données. Cette fermeture confirme la volatilité du marché et l’importance de ne pas dépendre d’un seul fournisseur.

Comment les plateformes d’avatars IA transforment-elles la vidéo d’entreprise ?

Les plateformes d’avatars IA créent des vidéos de type « talking head » à partir d’un script. Elles s’adressent aux équipes marketing, formation et communication qui produisent des démos produit, des tutoriels et des onboarding à grande échelle.

HeyGen : la traduction vidéo multilingue

HeyGen s’est imposé comme le leader de la vidéo d’avatar avec plus de 500 avatars disponibles et le support de 175 langues avec doublage IA. Sa fonctionnalité phare prend une vidéo existante d’une personne réelle et la double dans une autre langue avec synchronisation labiale convaincante. Le plan Creator coûte 24 $ par mois pour des vidéos illimitées en résolution standard.

L’expérience terrain avec HeyGen confirme sa force pour les contenus multilingues et les vidéos publicitaires personnalisées. La synchronisation labiale produit des résultats exploitables pour les réseaux sociaux. Les limites apparaissent sur les mouvements corporels complexes et les expressions faciales nuancées, où l’effet « vallée de l’étrange » persiste. Pour une stratégie complète de publicité vidéo IA sur les réseaux sociaux, combiner HeyGen pour les talking heads et un générateur cinématique pour le B-roll donne les meilleurs résultats.

Synthesia : le standard de la formation d’entreprise

Synthesia domine la vidéo de formation corporate. Son framework FOCA (Focus, Overview, Content, Action) structure les vidéos pédagogiques. Les avatars Express-2 réalisent des gestes précis (pointer un graphique, hocher la tête) adaptés au contexte professionnel. La conformité SOC2 et le SSO en font la seule option viable pour les DSI exigeants en matière de sécurité.

Les coûts de production vidéo avec ces plateformes ont baissé de 70 à 90 % par rapport aux méthodes traditionnelles. Une vidéo qui nécessitait un tournage à 500 € minimum se produit pour moins de 1 € avec un avatar IA.

Évaluez votre maturité IA en 5 minutes avec notre Diagnostic IA gratuit.

Quels outils IA émergents changent la production vidéo en 2026 ?

Trois tendances redéfinissent la production vidéo IA en 2026 : l’agrégation multi-modèles, la génération audio-visuelle unifiée, et les workflows automatisés de bout en bout.

Higgsfield : 15 modèles dans un seul espace de travail

Higgsfield agrège plus de 15 modèles de génération vidéo (Sora 2, Veo 3.1, Kling 3.0, Seedance 2.0) sous un abonnement unique. La plateforme génère environ 4 millions de vidéos par jour. Son Cinema Studio simule des optiques réelles : choix du boîtier, du type d’objectif et de la focale avant la génération. Les mouvements de caméra incluent le Bullet Time, les plans séquence et les transitions multi-axes.

Le retour d’expérience avec Higgsfield révèle un gain de temps considérable. Comparer les résultats de plusieurs modèles côte à côte, dans la même interface, accélère le processus créatif. Un clip Kling 3.0 coûte environ 0,60 $ sur la plateforme, contre 4 à 11 $ pour un clip Sora 2. La fonctionnalité Click-to-Ad transforme un lien produit en vidéo publicitaire en 2 à 5 minutes, avec GPT-4.1 pour l’analyse d’intention et Sora 2 pour la génération.

Seedance 2.0 : la génération audio-visuelle en un seul passage

Seedance 2.0 de ByteDance introduit une architecture Dual-Branch Diffusion Transformer qui génère mouvement, son et parole simultanément. Le modèle accepte jusqu’à 12 assets en entrée (images, clips vidéo, clips audio, texte) et produit des séquences multi-plans avec synchronisation audio native. Cette approche unifiée élimine le décalage entre audio et vidéo qui affectait les générations précédentes.

La convergence est la tendance majeure de 2026 : les plateformes d’avatars ajoutent du B-roll génératif, les outils cinématiques intègrent la voix et les présentateurs. La génération audio native deviendra un standard d’ici fin 2026. Pour automatiser la distribution des vidéos produites, un pipeline multi-agents n8n connecte la génération à la publication sur tous les canaux.

En pratique

Pour tester les générateurs cinématiques sans engagement : Kling offre 66 crédits gratuits par jour, Google Veo est gratuit via Gemini sans watermark, et Pika propose un plan gratuit. Lancez le même prompt sur trois plateformes pour comparer la qualité de mouvement, l’adhérence au prompt et la cohérence temporelle.

Comment choisir le bon outil vidéo IA selon son besoin et son budget ?

Le choix d’un outil vidéo IA dépend de trois facteurs : le type de contenu (motion design, cinématique, talking head), le volume de production, et le niveau de contrôle technique souhaité.

Trois catégories, trois logiques de production

La production programmatique avec Claude Code et Remotion s’adresse aux équipes techniques qui produisent des vidéos paramétriques en volume : visualisations de données, démos produit, tutoriels branded. Le coût marginal par vidéo tend vers zéro après la création du template. Cette approche exige des compétences en développement ou un usage avancé de Claude Code.

Les générateurs cinématiques (Kling, Runway, Veo) conviennent aux équipes créatives qui ont besoin de B-roll, de plans d’ambiance ou de maquettes visuelles. Le coût par clip varie de 0,60 $ (Kling) à 5 $ (Sora 2, Veo). Le contrôle reste probabiliste : le résultat varie à chaque génération.

Les plateformes d’avatars (HeyGen, Synthesia) ciblent les équipes marketing et RH qui produisent des vidéos de présentation structurées. Le retour sur investissement est immédiat pour les contenus multilingues : une seule prise, 175 langues en sortie.

Grille de décision par cas d’usage

| Besoin | Outil recommandé | Budget mensuel |

|---|---|---|

| Vidéos motion design en volume | Claude Code + Remotion | 20 € (Claude Pro) |

| B-roll cinématique | Kling 3.0 ou Runway | 7-35 $/mois |

| Vidéos d’entreprise multilingues | HeyGen | 24-39 $/mois |

| Formation corporate | Synthesia | Sur devis |

| Multi-modèles comparatifs | Higgsfield | 34 $/mois (Plus) |

| Publicités produit automatisées | Creatify ou Higgsfield | 10-34 $/mois |

Un enseignement clé issu de l’expérience avec ces plateformes : aucun outil ne couvre tous les besoins. Les meilleures productions combinent Remotion pour les templates branded, un générateur cinématique pour le B-roll, et un outil d’avatar pour les séquences de présentation. La fermeture de Sora rappelle l’importance de diversifier ses outils et de ne jamais bâtir un workflow sur un seul fournisseur.

Comment intégrer la vidéo IA dans sa stratégie de contenu et de visibilité ?

La vidéo IA n’est pas un gadget isolé. Elle s’intègre dans une stratégie de contenu globale qui combine SEO, GEO et distribution multicanale. Chaque vidéo produite alimente plusieurs points de contact : site web, réseaux sociaux, campagnes email, présentations commerciales.

Automatiser la production et la distribution

Un pipeline vidéo IA complet connecte la génération à la publication. Remotion génère la vidéo. Un workflow n8n envoie le fichier vers WordPress, LinkedIn, YouTube et Instagram avec les métadonnées adaptées à chaque plateforme. Cette automatisation SEO et GEO réduit le temps de distribution de plusieurs heures à quelques minutes.

Les vidéos courtes (15 à 60 secondes) dominent les algorithmes sociaux en 2026. Un template Remotion configuré une fois permet de produire des dizaines de variantes en batch. Chaque variante peut cibler un segment d’audience, une langue ou un réseau spécifique. Pour la création de publicités vidéo étape par étape, cette approche réduit le coût par variante à quelques centimes.

Mesurer l’impact et itérer

Le contenu vidéo améliore les signaux GEO : les pages contenant des vidéos avec transcript obtiennent une visibilité 3,7 fois supérieure dans les AI Overviews. Les moteurs IA citent les pages qui proposent un contenu multimodal (texte, image, vidéo avec transcription) en priorité par rapport aux pages texte seul.

Les indicateurs à suivre sont le taux de complétion, le coût par vue, le taux de partage et l’impact sur les citations IA. Un tableau de bord connecté via les outils vidéo IA et les MCP Google Analytics permet de croiser les données de performance vidéo avec les métriques SEO et GEO. Lancez votre premier template Remotion cette semaine, testez trois générateurs cinématiques, et mesurez les résultats sur 30 jours.

- Remotion + Claude Code pour les templates branded et le batch rendering à coût marginal zéro

- Kling 3.0 ou Veo 3.1 pour le B-roll cinématique à moins de 1 $ par clip

- HeyGen pour les vidéos multilingues avec synchronisation labiale native en 175 langues

- Higgsfield pour comparer 15 modèles dans un seul espace de travail et optimiser chaque plan

- Pipeline n8n pour automatiser la distribution sur tous les canaux depuis une seule source

- Mesure d’impact via MCP GA4 pour croiser performance vidéo et citations IA

Méthodologie

Cet article s’appuie sur les données publiées par Remotion (GitHub), Remotion Skills Documentation, OpenAI (étude de cas Higgsfield) et les comparatifs de générateurs vidéo IA de mars-avril 2026. Les prix et fonctionnalités correspondent aux données en vigueur en avril 2026.

📞 Appelez Eric au 06 25 34 34 25

Diagnostic IA gratuit · Nous contacter · SEO & GEO automatisé

Questions fréquentes sur la vidéo IA et Remotion

Qu’est-ce que Remotion et pourquoi l’utiliser pour créer des vidéos ?

Remotion est un framework open source qui permet de créer des vidéos en écrivant du code React au lieu d’utiliser un logiciel de montage traditionnel. Le projet cumule 28 000 étoiles GitHub et 400 000 téléchargements npm mensuels en avril 2026. Remotion s’adresse aux équipes qui ont besoin de vidéos paramétriques, personnalisables et reproductibles à grande échelle, comme les démos produit, les visualisations de données ou les contenus branded en batch.

Comment fonctionne le couple Claude Code et Remotion pour la production vidéo ?

Claude Code est l’outil en ligne de commande agentique d’Anthropic. Combiné à Remotion Skills (lancé en janvier 2026, 30 000 installations hebdomadaires), il permet de décrire une vidéo en langage naturel et d’obtenir le code React correspondant, prévisualisable dans le navigateur puis exportable en MP4. Le processus remplace plusieurs heures de montage manuel par 5 à 10 minutes de conversation avec l’agent IA.

Quel est le meilleur générateur vidéo IA cinématique en 2026 ?

Le choix dépend du budget et du besoin. Kling 3.0 de Kuaishou offre le meilleur rapport qualité-prix à 6,99 $/mois avec des clips de 3 minutes en 1080p. Runway Gen-4.5 propose le meilleur contrôle créatif pour les professionnels à 12 $/mois. Google Veo 3.1 excelle en réalisme physique et offre un accès gratuit via Gemini sans watermark. Chaque outil a ses forces : tester le même prompt sur trois plateformes aide à identifier la meilleure option.

Pourquoi OpenAI a-t-il fermé Sora en mars 2026 ?

OpenAI a annoncé la fermeture de Sora le 24 mars 2026, six mois après son lancement public. L’application, l’API et le partenariat Disney ont été abandonnés. Les utilisateurs ont jusqu’au 26 avril 2026 pour exporter leurs données, l’API restant active jusqu’en septembre 2026. Cette fermeture souligne le risque de dépendance à un seul fournisseur dans un marché en mutation rapide.

Qu’est-ce que Higgsfield et comment se distingue-t-il des autres outils ?

Higgsfield est une plateforme créative qui agrège plus de 15 modèles de génération vidéo (Sora 2, Veo 3.1, Kling 3.0, Seedance 2.0) dans un seul espace de travail. La plateforme génère environ 4 millions de vidéos par jour. Son Cinema Studio simule des optiques réelles et propose plus de 70 presets cinématiques. Un abonnement unique donne accès à tous les modèles, ce qui évite de cumuler plusieurs abonnements séparés.

HeyGen est-il adapté aux petites entreprises pour la vidéo marketing ?

HeyGen propose un plan Creator à 24 $/mois avec des vidéos illimitées en résolution standard et le support de 175 langues avec synchronisation labiale IA. Pour une PME qui produit des vidéos de présentation, des démos produit ou des publicités personnalisées, le rapport coût-efficacité surpasse les méthodes traditionnelles de 70 à 90 %. Le plan gratuit permet de tester 3 vidéos par mois avant de s’engager.

Combien coûte la production d’une vidéo avec l’IA en 2026 ?

Les coûts varient selon l’approche. Un clip Kling 3.0 revient à environ 0,60 $ sur Higgsfield. Un clip Sora 2 coûte 4 à 11 $. La production programmatique via Claude Code et Remotion ne coûte que l’abonnement Claude Pro à 20 €/mois, avec un coût marginal proche de zéro par vidéo produite. Pour comparaison, une vidéo traditionnelle avec vidéaste coûte au minimum 500 €.

Peut-on utiliser Remotion sans savoir coder ?

Remotion Skills combiné à Claude Code réduit considérablement la barrière technique. L’utilisateur décrit la vidéo souhaitée en langage naturel, et l’agent IA génère le code React automatiquement. Node.js et un abonnement Claude Code sont nécessaires pour l’installation. Un développeur débutant peut produire sa première vidéo en 15 minutes. Sans aucune connaissance technique, les plateformes comme HeyGen ou Kling offrent des interfaces visuelles plus accessibles.

Quelles sont les limites actuelles des générateurs vidéo IA ?

Les principales limites en 2026 concernent la durée (8 à 60 secondes selon les modèles pour les cinématiques), la cohérence anatomique (les mains et les doigts restent problématiques), et le contrôle précis de la composition. Le rendu frame par frame de Remotion est gourmand en ressources CPU. Les plans gratuits ajoutent des watermarks et limitent la résolution à 720p. La convergence rapide du marché corrige ces limites mois après mois.

Comment intégrer la vidéo IA dans une stratégie SEO et GEO ?

Les pages contenant des vidéos avec transcription obtiennent une visibilité jusqu’à 3,7 fois supérieure dans les AI Overviews de Google. Pour maximiser l’impact GEO, chaque vidéo doit être accompagnée d’un transcript complet, de données structurées VideoObject en Schema.org, et d’un texte alternatif descriptif. Les workflows n8n automatisent la distribution vers WordPress, LinkedIn et YouTube avec les métadonnées adaptées à chaque plateforme.

Diag IA gratuit

Nous contacter

Parler à Eric