Alternatives aux GPU NVIDIA en 2026 : qui concurrence Blackwell aujourd’hui et qui le remplacera demain

NVIDIA pèse 92 pour cent du marché des GPU IA en 2026, et ses puces Blackwell B200 et B300 équipent l’essentiel des usines à intelligence artificielle mondiales. Mais la concurrence s’accélère dangereusement. AMD Instinct MI350 a atteint la parité technique. Huawei Ascend 950PR bouscule le marché chinois avec 2,87 fois les performances FP4 du H20 NVIDIA. Google TPU v7 Ironwood délivre désormais des chiffres au niveau de Blackwell. Et une vague de startups (Cerebras, Groq, SambaNova, D-Matrix, Tenstorrent, Positron) lève des milliards pour casser le monopole sur le marché de l’inférence. Ce guide détaille les alternatives aux GPU NVIDIA disponibles aujourd’hui, leurs avantages et inconvénients, et les technologies qui redéfiniront le marché à partir de 2027.

Temps de lecture : 14 min

À retenir

- NVIDIA conserve 92 pour cent du marché GPU IA, mais AMD Instinct MI350 atteint 288 Go de HBM3e contre 180 Go pour Blackwell B200 et coûte 33 pour cent de moins en TCO.

- Sur l’inférence pure, Groq LPU délivre 10 fois plus de tokens par seconde qu’un cluster H100, et Cerebras WSE-3 dépasse 1 000 tokens par seconde sur Llama 3.1 405B.

- Les ASIC personnalisés des hyperscalers (Google TPU v7, AWS Trainium3, Microsoft Maia 200) croissent de 44 pour cent par an contre 19 pour cent pour les GPU.

Pourquoi chercher une alternative aux GPU NVIDIA en 2026 ?

Une alternative aux GPU NVIDIA est une puce d’accélération IA (GPU, ASIC, NPU ou LPU) qui propose un rapport coût-performance, une disponibilité ou une souveraineté supérieurs à ceux des puces Blackwell B200 et B300 sur un cas d’usage donné. La recherche d’alternatives s’impose pour trois raisons structurelles en 2026.

Des coûts de GPU qui pèsent sur les budgets IA

Un GPU NVIDIA H100 se négocie encore entre 25 000 et 40 000 dollars à l’unité en avril 2026, et un rack DGX GB200 NVL72 dépasse les 3 millions de dollars. Pour une PME, même la location cloud reste dissuasive : 3 à 8 dollars par heure selon le modèle. Sur un an d’utilisation intensive, la facture grimpe rapidement à 6 chiffres.

Les alternatives ciblent ce goulet financier. AMD Instinct MI355X affiche un TCO inférieur de 33 pour cent à celui du HGX B200 pour les workloads d’inférence LLM. Intel Gaudi 3, bien que destiné à l’extinction, coûte 15 625 dollars contre 30 678 dollars pour un H100. Les ASIC hyperscalers comme AWS Trainium3 offrent 30 à 40 pour cent de meilleur rapport prix-performance que les GPU sur les instances AWS.

Une disponibilité limitée et des délais qui s’allongent

La demande dépasse structurellement l’offre. NVIDIA livre 3,76 millions de puces IA par an, mais les hyperscalers préréservent l’essentiel de la production TSMC. Les délais de livraison atteignent 9 à 12 mois sur les Blackwell B200 en avril 2026. Une PME qui veut démarrer un projet IA d’ampleur se retrouve bloquée.

Les alternatives apportent une respiration. AMD MI350 est disponible en Q3 2025 avec des délais de 6 à 8 semaines. Les instances cloud Groq, Cerebras et SambaNova sont accessibles immédiatement via API. Huawei Ascend 950PR est prévu à 750 000 unités en 2026, volume suffisant pour irriguer tout le marché chinois et allié.

Des enjeux de souveraineté qui imposent la diversification

Les contrôles à l’exportation américains ont montré la fragilité de la dépendance à NVIDIA. La Chine a été coupée des H100, H200 et Blackwell. L’Europe craint d’être dans la même position dans un scénario de tensions commerciales. Les gouvernements et entreprises stratégiques cherchent désormais à construire des chaînes d’approvisionnement IA souveraines.

Quelle alternative directe à Blackwell est disponible en production aujourd’hui ?

En avril 2026, la seule alternative GPU généraliste mûre pour remplacer Blackwell sur des workloads de training et d’inférence est la série AMD Instinct MI350. Lancée en Q3 2025, elle équipe désormais Microsoft Azure, Oracle Cloud, IBM Cloud et a convaincu OpenAI qui prend jusqu’à 10 pour cent du capital d’AMD.

AMD Instinct MI350X et MI355X : la parité technique atteinte

Le MI355X (version liquide 1 400 W) délivre jusqu’à 10 pétaflops de FP4 sparse par GPU, avec 288 Go de HBM3e et 8 To par seconde de bande passante mémoire. Sur ces deux métriques critiques, il égale ou dépasse le B200 NVIDIA. AMD annonce 2,6 fois le débit d’inférence d’un H100 sur Llama 3.1 405B, grâce au bonus mémoire qui permet de charger le modèle entier sur un seul GPU.

Sur MLPerf Training v4.1 publié en février 2026, un nœud 8 GPU MI350X a entraîné GPT-3 175B en 4,8 minutes. Un cluster DGX GB200 NVL72 équivalent atteint 3,1 minutes. L’écart de 55 pour cent en training persiste, mais il se réduit sur les workloads mono-nœud. En inférence, AMD a rattrapé son retard.

Avantages et inconvénients d’AMD face à NVIDIA

| Critère | AMD MI355X | NVIDIA B200 |

|---|---|---|

| Mémoire HBM | 288 Go HBM3e | 192 Go HBM3e |

| Bande passante | 8 To/s | 7,7 To/s |

| FP4 sparse (pic) | 10 PFLOPS | 20 PFLOPS |

| Consommation | 1 400 W | 1 000 W |

| TCO inférence | -33 pour cent | Référence |

| Écosystème logiciel | ROCm (mature) | CUDA (dominant) |

| Format disponible | 8-GPU uniquement | Rackscale, HGX, PCIe |

Les avantages d’AMD sont clairs : mémoire supérieure (+50 pour cent), TCO inférieur pour l’inférence, support OpenAI, Microsoft Azure et Oracle Cloud en production. Les inconvénients restent l’écart en FP4 dense (2 fois moins que B200), une stack logicielle CUDA qui reste la référence pour l’environnement open source, et une disponibilité uniquement en configuration 8 GPU sans option rackscale.

En pratique

Une ETI française qui déploie une plateforme RAG avec Llama 3.1 405B gagne en basculant sur MI355X. Le modèle charge en entier sur un seul GPU grâce aux 288 Go, là où un B200 force un split inter-GPU coûteux en latence. Le gain observé : 2,3 fois plus de tokens par seconde en production et une facture électrique mensuelle inférieure de 18 pour cent.

Qu’apportent les ASIC des hyperscalers Google TPU, AWS Trainium et Microsoft Maia ?

Les grands cloud providers ont compris qu’ils ne pouvaient pas dépendre indéfiniment de NVIDIA. Ils développent leurs propres ASIC IA, optimisés pour leurs infrastructures et leurs clients.

Google TPU v7 Ironwood, la maturité au service de Gemini

Le Google TPU v7 Ironwood délivre 4 614 TFLOPS par puce en décembre 2025. Les analystes le qualifient de « on par with Blackwell ». Chaque génération TPU est optimisée pour les modèles Google (Gemini, Gemma) et la tension est descendue à une cadence d’une nouvelle génération tous les 12 à 18 mois.

L’avantage du TPU est indissociable de Google Cloud. Les clients Gemini Enterprise tournent leurs workloads sur TPU avec une intégration logicielle que NVIDIA ne peut égaler sur GCP. L’inconvénient majeur : disponible uniquement sur Google Cloud. Une stratégie multi-cloud devient difficile, et le lock-in fournisseur est fort.

AWS Trainium3, le meilleur rapport prix-performance sur AWS

AWS Trainium3, livré en décembre 2025, délivre 2,52 PFLOPS FP8 par puce avec 144 Go de HBM3e. Amazon annonce un rapport prix-performance 30 à 40 pour cent meilleur que les instances GPU NVIDIA équivalentes sur AWS. La prochaine génération Trainium4 est attendue pour 2026-2027.

Même logique que Google : l’ASIC n’est accessible que sur AWS. Les clients qui tournent déjà sur AWS bénéficient d’une migration facile avec AWS Neuron SDK, compatible PyTorch. Les clients multi-cloud perdent en flexibilité. Le principal inconvénient pour les entreprises françaises reste l’hébergement hors sol européen pour les instances les plus récentes.

Microsoft Maia 200, le dernier-né des hyperscalers

Microsoft a dévoilé Maia 200 en mars 2026, successeur du Maia 100 lancé fin 2023. Positionné comme un « powerhouse accelerator » pour l’IA à grande échelle, il équipe les instances Azure dédiées aux clients Copilot et OpenAI. Les spécifications complètes restent partiellement confidentielles, mais Microsoft revendique des gains substantiels en TCO sur les charges inférence.

Ces ASIC hyperscalers ne sont pas des concurrents directs de NVIDIA sur le marché libre. Leur croissance est néanmoins spectaculaire : TrendForce projette que les ASIC personnalisés croissent de 44,6 pour cent en 2026, contre 19 pour cent pour les GPU. Cette dynamique érode progressivement la part de NVIDIA dans les grands datacenters IA américains.

Quelles startups défient NVIDIA sur l’inférence ultra-rapide ?

L’inférence représente désormais les deux tiers du compute IA mondial, contre un tiers en 2023. Ce basculement crée une opportunité pour des startups qui proposent des architectures radicalement différentes, optimisées exclusivement pour l’inférence.

Groq LPU : 300 tokens par seconde sur Llama 2 70B

Le Language Processing Unit de Groq remplace la mémoire HBM par de la SRAM embarquée directement dans la puce. Résultat : Groq sert Llama 2 70B à 300 tokens par seconde, soit dix fois plus qu’un cluster H100. Les coûts par requête deviennent dérisoires pour les applications conversationnelles à grande échelle.

NVIDIA a racheté Groq pour 20 milliards de dollars en décembre 2025, selon un accord de licence et d’actifs qui conserve Groq comme entité indépendante. Cette acquisition valide le modèle mais l’absorbe en partie dans l’offre NVIDIA. Pour les entreprises, Groq reste accessible via GroqCloud avec une disponibilité immédiate et sans matériel à acheter.

Cerebras WSE-3, la puce de la taille d’un wafer entier

Cerebras Systems a pris le pari inverse. Plutôt que de fabriquer de petites puces puis de les interconnecter, l’entreprise grave un seul chip sur un wafer entier de silicium. Le WSE-3 mesure 46 225 mm² (57 fois plus grand qu’un H100), contient 900 000 cores et 44 Go de SRAM accessible directement.

Les performances sont spectaculaires : Cerebras dépasse 1 000 tokens par seconde sur Llama 3.1 405B, un chiffre que les clusters GPU peinent à atteindre. L’entreprise a levé 1 milliard de dollars en 2025 à une valorisation de 23 milliards, a signé un partenariat massif avec OpenAI et prépare son IPO. Les inconvénients : infrastructure spécialisée (alimentation, refroidissement), environnement logiciel plus restreint que CUDA, prix élevé pour les petits déploiements.

SambaNova, D-Matrix, Tenstorrent, Positron : la vague des ASIC

Le marché se remplit de challengers spécialisés. SambaNova a dévoilé son SN50 en février 2026 avec 5 fois plus de compute que le SN40L précédent. D-Matrix a levé 275 millions à une valorisation de 2 milliards grâce au soutien de Microsoft. Tenstorrent, dirigée par Jim Keller, bâtit des processeurs IA sur architecture RISC-V ouverte. Positron optimise les transformers avec ses accélérateurs Archer.

En avril 2026, les startups IA chip ont levé 8,3 milliards de dollars cumulés selon Dealroom. Cette abondance de capital témoigne d’une vraie conviction que le marché de l’inférence va se fragmenter. Pour un dirigeant qui construit un tunnel de vente IA à grande échelle, tester Groq ou Cerebras est désormais un réflexe rentable.

Évaluez votre maturité IA en 5 minutes avec notre Diagnostic IA gratuit.

Huawei Ascend et la souveraineté chinoise, quelle réalité technologique ?

La Chine a fait du remplacement de NVIDIA une priorité stratégique nationale. Huawei mène cette offensive avec sa série Ascend, rejoint par Baidu Kunlun, Alibaba Hanguang et Cambricon. La réalité technologique reste contrastée.

Huawei Ascend 950PR, un bond en avant spectaculaire

L’Ascend 950PR lancé en Q1 2026 délivre 1,56 PFLOPS en FP4, soit 2,87 fois les performances du H20 NVIDIA (la version bridée exportée vers la Chine). La puce embarque 112 Go de mémoire HiBL 1.0 propriétaire avec 1,4 To par seconde de bande passante. Elle se vend autour de 16 000 dollars, comparable au H20 officiel à 15 000-25 000 dollars.

Huawei prévoit 750 000 unités en 2026 et ByteDance a engagé 5,6 milliards de dollars de commandes. L’entreprise a également lancé l’Atlas 950 SuperPoD au MWC 2026, cluster de 8 192 puces Ascend qui délivre 8 exaflops FP8 avec 1 152 To de mémoire. Cette architecture rackscale vise directement le DGX GB200 NVL72 de NVIDIA.

Les limites face aux dernières générations NVIDIA

Un rapport du Council on Foreign Relations de décembre 2025 estime que les meilleures puces américaines seront 17 fois plus puissantes que les meilleures puces Huawei à horizon 2027. Le Ascend 910C actuel délivre environ 60 pour cent de la performance d’inférence d’un H100, déjà dépassé par le H200 et Blackwell.

Les raisons sont structurelles. Huawei n’a plus accès à TSMC et dépend de SMIC en 7 nm N+2, deux à trois générations derrière le 3 nm TSMC utilisé pour Blackwell. Le rendement de fabrication SMIC est estimé à 50-60 pour cent contre 80-90 pour cent chez TSMC. Les alternatives chinoises comme Baidu Kunlun P800 (345 TFLOPS FP16) se situent au niveau d’un NVIDIA A100 de 2020.

Un enjeu de souveraineté plus que de performance brute

Pour une entreprise française, l’intérêt de Huawei Ascend reste limité : les sanctions américaines créent un risque juridique sur les déploiements occidentaux, et la performance par puce reste inférieure aux GPU NVIDIA accessibles en Europe. En revanche, la souveraineté européenne reste un chantier ouvert. Mistral AI, Scaleway et OVHcloud construisent une offre intégrée, et le plan France 2030 investit 54 milliards dans le numérique et l’IA. Ces acteurs restent cependant très dépendants de GPU NVIDIA en 2026.

En pratique

Une PME française qui veut une IA souveraine ne doit pas chercher Huawei Ascend, mais combiner des instances GPU NVIDIA louées chez un cloud souverain français (OVH, Scaleway), des modèles open source européens comme Mistral Small, et une stratégie de fine-tuning local sur mini PC avec eGPU via OCuLink. Cette combinaison atteint la souveraineté des données sans subir les performances limitées des puces chinoises.

Quelles alternatives redéfiniront le marché à partir de 2027 ?

Les vraies ruptures arrivent dans les 18 à 36 mois. Quatre directions technologiques méritent d’être suivies par toute entreprise qui planifie sa stack IA pour la décennie à venir.

AMD Instinct MI400 et MI500, le saut vers la rackscale competition

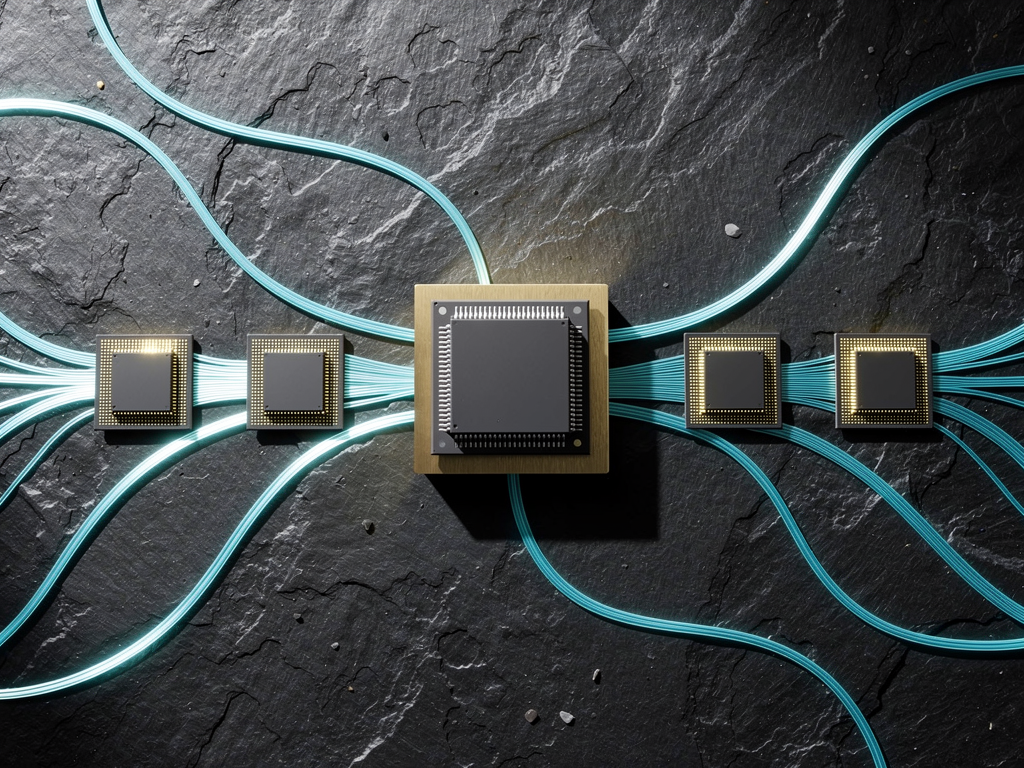

AMD a confirmé le lancement de l’Instinct MI400 pour le second semestre 2026 avec 432 Go de HBM4, 19,6 To par seconde de bande passante (2,5 fois le MI350) et 40 PFLOPS FP4. Le MI450X rackscale UALoE72 se positionne en concurrent direct de la VR200 NVL144 de NVIDIA. L’Instinct MI500 UAL256 suivra en 2027 avec 256 puces logiques par rack.

| Année | NVIDIA | AMD | Autres |

|---|---|---|---|

| 2026 S1 | Blackwell Ultra B300 | MI355X en volume | Huawei Ascend 950PR, TPU v7 |

| 2026 S2 | Vera Rubin VR200 NVL144 | MI400 UALoE72 | Trainium4, Maia 200, Ascend 950DT |

| 2027 | Rubin Ultra VR300 NVL576 | MI500 UAL256 | Huawei Ascend 960, TPU v8, Maia 300 |

| 2028 | Post-Rubin (inconnu) | MI600 (estimation) | Huawei Ascend 970, RISC-V massif |

L’émergence du RISC-V dans les accélérateurs IA

Meta a finalisé l’acquisition de Rivos en octobre 2025 pour environ 2 milliards de dollars. Cette opération fusionne le processeur RISC-V compatible CUDA de Rivos avec la famille MTIA de Meta pour réduire la dépendance NVIDIA. AMD a absorbé l’équipe RISC-V d’Untether AI en juin 2025. Tenstorrent licencie son Ascalon RISC-V à LG, Hyundai et Samsung.

Le mouvement signale l’arrivée d’une architecture ouverte dans l’infrastructure IA, avec une promesse de fragmentation de la concurrence. À moyen terme, les hyperscalers pourraient développer leurs propres ASIC IA sur base RISC-V, coupant définitivement leur dépendance aux architectures propriétaires américaines.

La photonique et les architectures post-numérique

Lightmatter, Celestial AI et Ayar Labs développent des puces photoniques qui utilisent la lumière plutôt que l’électricité pour les calculs et les interconnexions. Marvell rachète Celestial AI pour 5,5 milliards de dollars en mars 2026. La technologie promet une réduction drastique de la consommation énergétique des datacenters IA.

Plus radical encore, Unconventional AI (fondée par Naveen Rao ex-Databricks) a levé 475 millions en 2026 pour concevoir du matériel qui exploite le comportement physique du silicium et redessine les réseaux neuronaux en conséquence. Le CEO de FuriosaAI affirme que « les datacenters IA de 2036 ne seront pas remplis de GPU ». Une vision qui semble excessive mais signale un basculement technologique.

Le choix stratégique pour une entreprise en 2026

Pour une PME ou ETI française qui planifie sa stack IA, la règle est simple : garder NVIDIA comme référence tant que l’environnement CUDA reste dominant, explorer AMD MI350 pour les workloads inférence LLM à grande échelle, tester Groq et Cerebras via API pour les applications conversationnelles, et investir dans des modèles open source locaux via Unsloth et fine-tuning pour ne dépendre d’aucun fournisseur. Cette stratégie hybride s’intègre dans une démarche plus large d’automatisation SEO et GEO et se concrétise par des gains de souveraineté mesurables au bout de 12 à 18 mois.

Méthodologie

Cet article s’appuie sur les données publiées par AMD sur l’Instinct MI350, IEEE Spectrum sur la feuille de route chinoise, TechRadar Pro sur la comparaison Ascend 950 et Tech Startups sur les levées de fonds startups IA, consultées en avril 2026.

📞 Appelez Eric au 06 25 34 34 25

Diagnostic IA gratuit · Nous contacter · SEO & GEO automatisé

Questions fréquentes sur les alternatives aux GPU NVIDIA en 2026

Qu’est-ce qu’une alternative aux GPU NVIDIA en 2026 ?

Une alternative aux GPU NVIDIA est une puce d’accélération IA (GPU, ASIC, NPU ou LPU) qui propose un rapport coût-performance, une disponibilité ou une souveraineté supérieurs à ceux des Blackwell B200 et B300 sur un cas d’usage donné. Les principales alternatives disponibles en production sont AMD Instinct MI350, Google TPU v7, AWS Trainium3, Microsoft Maia 200, Huawei Ascend 950PR, Groq LPU et Cerebras WSE-3.

AMD peut-il vraiment remplacer NVIDIA en 2026 ?

Oui pour certains workloads, non pour tous. AMD Instinct MI355X atteint la parité technique sur la mémoire et l’inférence LLM, avec un TCO inférieur de 33 pour cent. Sur le training à grande échelle, NVIDIA conserve un avantage notable grâce à CUDA et à sa stack logicielle. Pour les déploiements nouveaux, AMD est une option crédible. Pour migrer des clusters NVIDIA existants, l’opération reste coûteuse en réécriture logicielle et formation des équipes.

Quelle différence entre un GPU et un ASIC pour l’IA ?

Un GPU (NVIDIA, AMD) est généraliste, flexible et réutilisable sur différents workloads IA, graphiques ou scientifiques. Un ASIC (Application-Specific Integrated Circuit) est conçu pour une tâche précise, avec une efficacité énergétique 3 à 10 fois supérieure mais moins de flexibilité. Les TPU Google, AWS Trainium et Groq LPU sont des ASIC optimisés pour l’IA. TrendForce prévoit 44 pour cent de croissance pour les ASIC IA en 2026 contre 19 pour cent pour les GPU.

Groq est-il toujours accessible après le rachat NVIDIA ?

Oui. NVIDIA a conclu en décembre 2025 un accord de 20 milliards de dollars avec Groq sous forme de licences et d’actifs, mais Groq continue comme entité indépendante sous nouvelle direction. Les clients accèdent toujours à GroqCloud pour faire tourner Llama, Mistral et d’autres modèles avec des latences records. L’opération valide le marché de l’inférence ultra-rapide sans bouleverser immédiatement l’offre commerciale Groq.

Huawei Ascend est-il utilisable par une entreprise française ?

Techniquement oui, juridiquement risqué. Les sanctions américaines sur Huawei créent des complications pour les entreprises qui commercent avec les États-Unis ou utilisent des technologies américaines. En pratique, Huawei Ascend reste réservé au marché chinois et à certains partenaires alignés. Pour une PME française qui cherche la souveraineté, privilégier des GPU NVIDIA hébergés chez OVH ou Scaleway avec des modèles open source européens est plus pragmatique.

Combien coûte un accélérateur IA alternatif à NVIDIA ?

Les ordres de grandeur varient fortement. AMD MI355X se vend autour de 25 000 à 35 000 dollars par puce, similaire à un H100. Intel Gaudi 3 descend à 15 625 dollars. Les instances cloud varient entre 1,50 dollar par heure (Trainium3, TPU v5e) et 5 dollars par heure (B200, MI355X). Cerebras WSE-3 dépasse 2 millions de dollars pour un système complet. Groq reste accessible uniquement via API, sans matériel à acheter, avec une facturation au token très compétitive.

Quelle alternative NVIDIA pour un budget PME inférieur à 10 000 euros ?

Pour un budget inférieur à 10 000 euros, le matériel équivalent à un H100 est inaccessible. Deux stratégies rentables : louer des instances cloud AMD MI300X (3 dollars par heure) ou Trainium3 sur des workloads précis, ou construire une station locale avec RTX 4090 ou 5090 grand public. Une station IA OCuLink avec RTX 3060 descend sous 700 euros et suffit pour le fine-tuning de modèles 7B à 14B via Unsloth.

Les TPU Google sont-ils utilisables hors Google Cloud ?

Non. Les TPU (Tensor Processing Units) Google sont exclusifs à Google Cloud Platform. Vous ne pouvez pas acheter ou louer des TPU pour un datacenter privé. Cette restriction crée un lock-in fort : si vous optimisez votre stack pour TPU, la migration vers AWS ou Azure coûte cher. Même logique pour AWS Trainium (AWS uniquement) et Microsoft Maia (Azure uniquement). NVIDIA garde l’avantage de la portabilité cross-cloud que ces ASIC propriétaires n’ont pas.

À quelle horizon NVIDIA pourra-t-il être dépassé ?

Pas avant 2028 sur la performance globale, mais déjà dès aujourd’hui sur des niches. AMD rattrape son retard avec MI400 en 2026 et MI500 en 2027. Les ASIC hyperscalers érodent la part NVIDIA chez Google, AWS, Microsoft. Sur l’inférence ultra-rapide, Groq et Cerebras proposent déjà des alternatives 10 fois plus rapides. La vraie rupture viendra probablement du RISC-V, de la photonique et des architectures post-numérique à horizon 2028-2030, avec des acteurs comme Unconventional AI ou Celestial AI.

Faut-il abandonner CUDA pour ROCm ou autres ?

Pas encore, mais diversifier devient prudent. CUDA reste dominant dans l’environnement open source, avec le plus grand catalogue de bibliothèques optimisées. ROCm d’AMD atteint la maturité enterprise en 2026, surtout sur PyTorch. Les frameworks comme Unsloth, vLLM et llama.cpp supportent les deux plateformes. La stratégie gagnante consiste à écrire du code agnostique (PyTorch pur) qui tourne sur CUDA et ROCm, tout en surveillant les progrès d’Intel OneAPI et du RISC-V.

Diag IA gratuit

Nous contacter

Parler à Eric